IT之家3月28日消息 在上一周,IT之家报道了微软正式推出新一代全双工语音交互技术的消息,该技术已经在小冰全球产品线中落地。3月28日,微软在北京微软亚太研发集团大楼举办了小冰技术交流会,IT之家作为主流科技媒体受邀参加,一起见证和分享了微软小冰全双工语音交互技术的深度揭秘,以及全新的人工智能基础框架的变革。

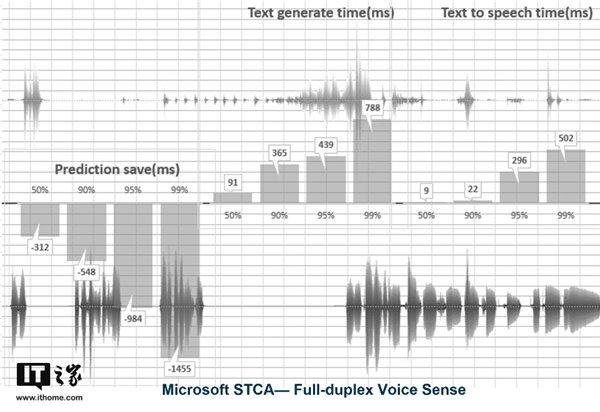

此前,微软(亚洲)互联网工程院宣布率先推出新一代的语音交互技术:全双工语音交互感官(Full-duplex Voice Sense),并已完成产品化落地。与既有的单轮或多轮连续语音识别不同,这项新技术可实时预测人类即将说出的内容,实时生成回应并控制对话节奏,从而使长程语音交互成为可能。此外,采用该技术的智能硬件设备,将不再需要用户在每轮交互时都说出唤醒词,仅需一次唤醒,就可以轻松实现连续对话,将语音交互的自然度推进到一个新的层次。比如之前微软和小米旗下米家生态链合作推出的Yeelight语音助手,就是全球首个搭载全双工语音交互感官的智能设备,也是内置微软小冰的首个“双AI”智能设备。

那么微软在小冰上的人工智能核心基础框架有何改变呢?

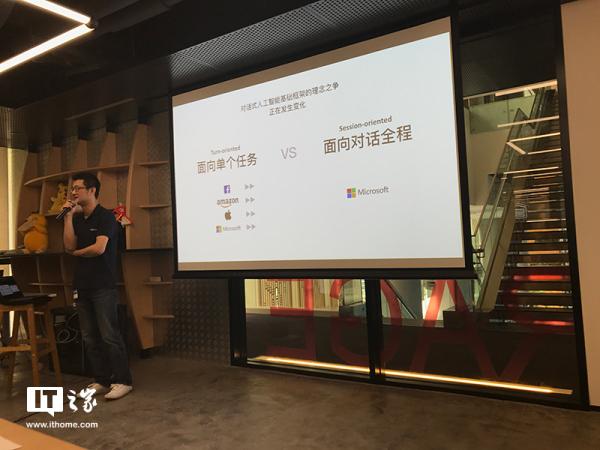

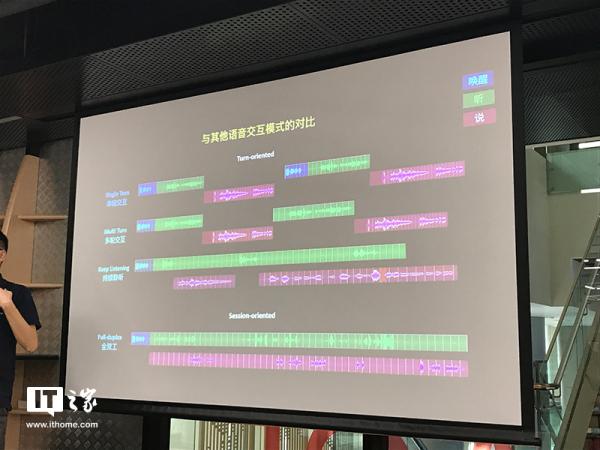

微软(亚洲)互联网工程院副院长李笛开场就表示,现在对话式人工智能基础框架的理念之争正在发生变化,由之前的Turn-oriented框架 — 面向单个任务,转向基于Session-oriented框架 — 面向整个对话全程的技术变革。特别是微软,已经实现了人工智能基础框架的转变,并且预测这将是人工智能发展的新趋势。

微软(亚洲)互联网工程院副院长李笛

微软在小冰技术交流会上表示,目前大多数的智能音箱或智能语音助手采用的是Turn-oriented框架,对话如十字路口,当用户提出问题后会将其引导到特定的场景并最大理想化完成特定任务。而小冰和微软研究发展的Session-oriented框架,对话如河流,在整个过程中既包含任务,也包括一些“无用的”对话,但这些对话中也可能引申出新的任务,并以更加自然交互的方式完成整个对话。

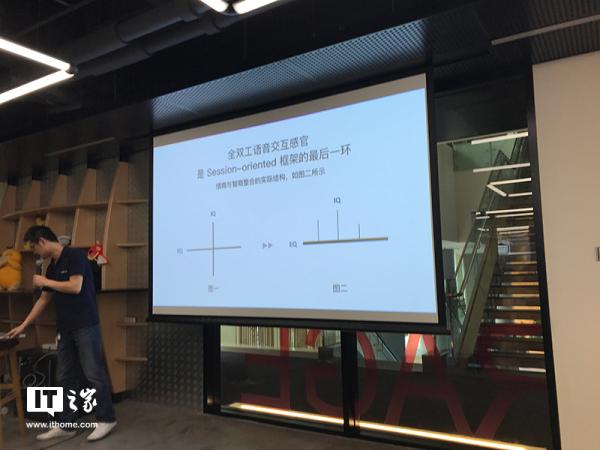

微软强调,基于Turn-oriented的框架因其存在上限,决定了这种内在基础的发展空间难以提高。目前新推出的Session-oriented框架还有很大的上升空间,其中的全双工语音交互感官功能是Session-oriented框架的最后一环,实际结构上是IQ贯穿和基于EQ之上,这也是之前微软大力发展基于情感的人工智能成果表现。

微软小冰全球研发负责人、首席架构师周力

在小冰技术交流会上,微软小冰全球研发负责人、首席架构师周力披露了部分技术特征:

边听边想:预测模型,现在无需等待用户把一句话说完,再进行语音识别,现在可以听到语音后就会提前预测用户的完整意思,与此同时,开始思考回应,以实现更快的响应速度和改口能力;动态回应,不再是用户输入一条,人工智能回应一条的回合制,而是根据预估思考时间、复杂任务的完成时间,有选择的将回答分成多段,减少用户感知的等待时间。这在搭载小冰的Yeelight语音助手等IoT等物联网设备使用体验上至关重要,使用自然交互,减少一些等待时间就能感觉到舒爽。

节奏控制器:节奏协调,包括与人工智能自己的协调,与人类对话的协调,还有和其他语音助手的协调,时机和内容同等重要。另外人工智能能否主动引导抛出新话题,提供新内容,打破沉默是重要特征;还有随着全双工语音交互技术的普及,和人类一样的非对称对话模式。

声音场景的理解:全双工语音交互场景包括分类器,比如语音身份的识别(男、女、儿童),触发不同内容的对话,语音情绪识别、音乐/歌声识别等;环境处理,针对背景的噪声识别与回声消除,小冰作为内容提供者和小冰语音助手混合状态,动态音量识别与调整。比如在小冰讲故事的时候,让音箱声音变小变大,小冰只是默默执行任务,但并不会打断讲故事这一场景;对象判断,支持了语音声纹识别,每个设备对应数个主要用户和新用户,是否在和小冰说话等,比如多人聊天、电视背景音,判断用户对话节奏来进行开始或停止响应。

自然语言理解与生成模型:实现更好的容错性、与语音合成更好地串行、基于整个对话场景的上下文理解,主动挂断的动态判断,基于时间、整个对话的内容、用户意图分类,动态决定小冰是否主动结束session。

IT之家报道,微软此前表示,语音交互是对话式人工智能及智能硬件设备的基础之一。全双工语音交互技术的应用,有望实现用户体验的下一次飞跃,并成为人工智能语音交互的新“标准配置”。

想看到更多这类内容?去APP商店搜IT之家,天天都有小欢喜。

鲁公网安备37020202000738号

鲁公网安备37020202000738号