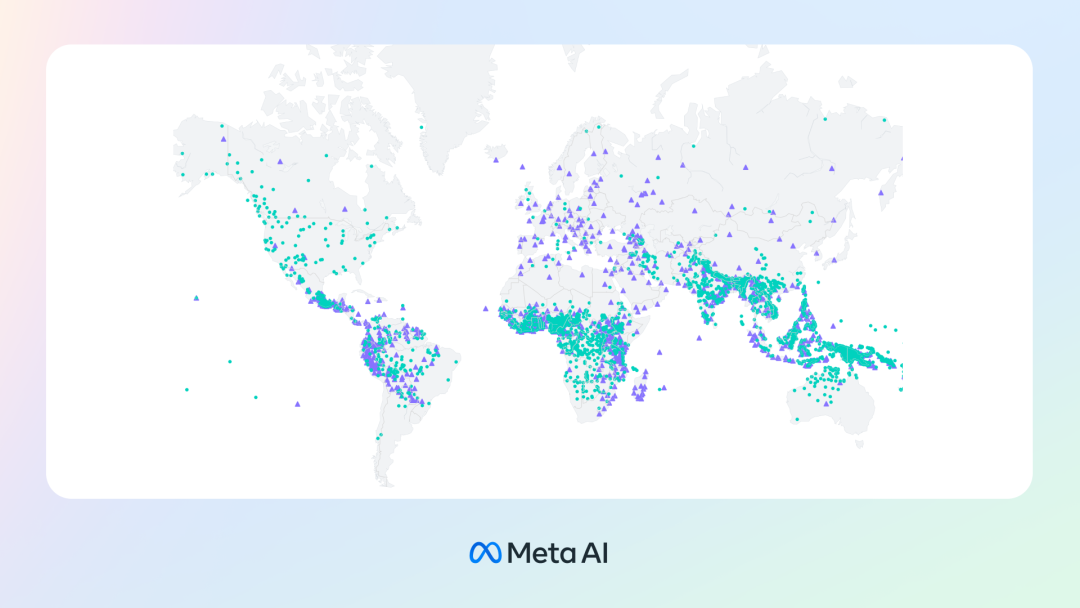

1. Meta的语音识别技术可识别1100多种语言

Meta科学家在一个名为Massively Multilingual Speech(MMS)的项目中取得了突破性进展,教会了机器如何理解和说出成千上万种语言。该技术使用自学习系统和超过1,100种语言的数据库,旨在使信息更易于获取,并帮助保护许多即将消失的语言。

主要亮点:

- Meta的语音识别技术能够识别和说出1100多种语言,这种技术突破了目前市场上其他语音识别技术的局限性。

- MMS项目使用自学习系统和大量语言数据库,从而使机器能够更好地理解和学习各种语言。

- 该技术的应用将使得更多的信息对不同语言的人们更加易于获取,同时也有助于保护那些即将消失的语言。

标签:科技新闻, 人工智能, 语音识别

查看原文/1[1]

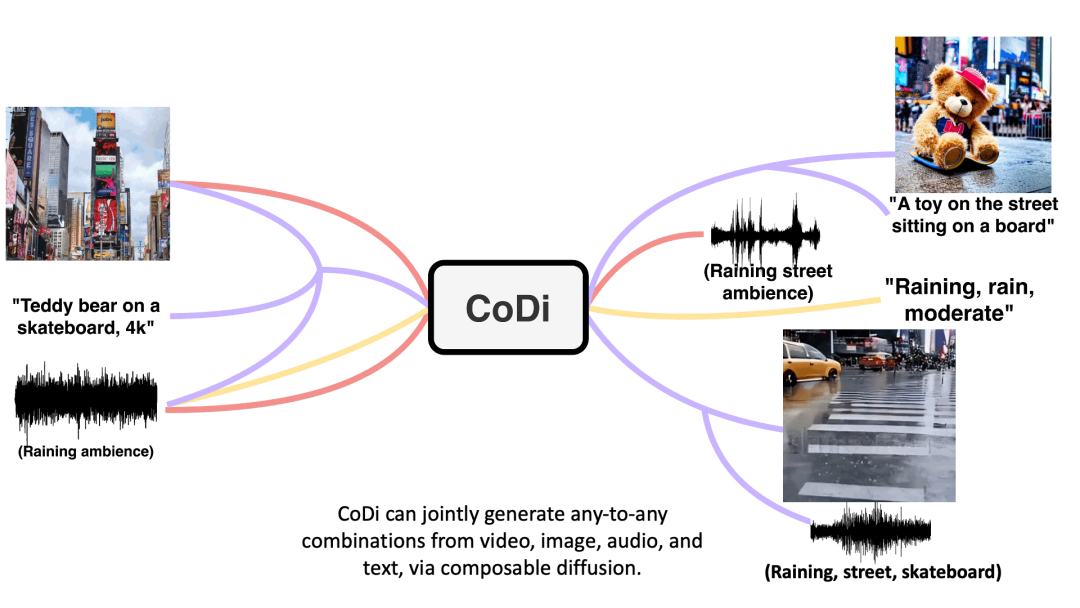

2. CoDi:通过可组合扩散实现任意生成

科技新闻:研究人员引入了一种独特的AI模型——可组合扩散(CoDi),它可以基于任何组合的输入生成任何混合输出类型,如语言、图像、视频或音频,这使它与传统的AI系统有所不同。尽管许多输入输出组合缺乏训练数据,但CoDi通过在输入和输出领域中对齐模态来填补这一空白,从而实现了相互关联的模式的同时生成,即使它们不是原始训练数据的一部分。

内容要点:

- CoDi是一种独特的AI模型,可以生成任何混合输出类型,如语言、图像、视频或音频,这使它与传统的AI系统有所不同。

- CoDi通过对齐输入和输出领域中的模态来填补许多输入输出组合缺乏训练数据的空白。

- CoDi可以同时生成相互关联的模式,即使它们不是原始训练数据的一部分。

标签:人工智能, 模型生成, CoDi

查看原文/2[2]

3. 英特尔发布Aurora GenAI,挑战ChatGPT

英特尔宣布推出Aurora GenAI,这是其与ChatGPT等AI模型竞争的产品,拥有高达1万亿个参数。该模型旨在应对复杂任务,承诺提升对话、翻译、摘要和编码能力。这是英特尔宏伟的AI战略的一部分,得到了学术和研究机构的合作支持。

核心要点

- 英特尔推出竞争ChatGPT的Aurora GenAI,参数达到1万亿个。

- 该模型旨在应对复杂任务,具有增强的对话、翻译、摘要和编码能力。

- 这是英特尔与学术和研究机构合作的一部分,是其宏伟的AI战略的一部分。

标签:人工智能, 英特尔, ChatGPT

查看原文/3[3]

4. GPT-JSON,将GPT的输出结果转为规范化的对象

GPT-JSON是一个用于将GPT的结果转换为规范化对象的工具。该工具提供了以下功能:

- 声明性地定义预期的输出格式,通过设置一个模式(schema)来实现。

- 编写一个提示(prompt),以获取符合预期格式的结果。

- 将结果转为美观的、带类型提示的对象。

GPT-JSON的出现,将使得GPT的输出结果更加规范化,方便开发者进行二次开发和应用。

标签:GitHub, GPT, 开发工具

查看原文/4[4]

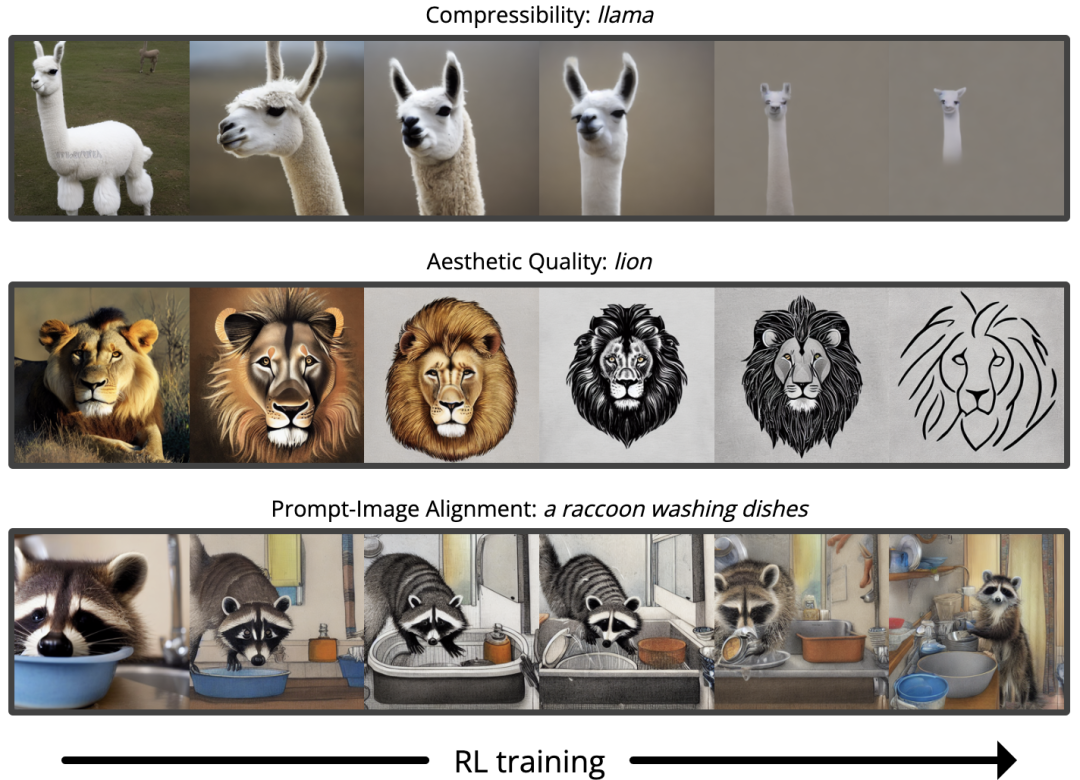

5. 通过强化学习训练扩散模型

在最近的工作中,强化学习一直备受关注,主要集中在人类反馈方面。但事实证明,您也可以使用计算反馈作为奖励模型。在这项工作中,他们使用LLaVA视觉问答系统为多个不同任务给出bert分数。有趣的是,他们能够显着提高基础扩散模型的性能。

核心要点:

- 强化学习可以使用计算反馈作为奖励模型。

- 使用LLaVA视觉问答系统为多个不同任务给出bert分数。

- 可以显着提高基础扩散模型的性能。

标签:强化学习, 计算反馈, 扩散模型

查看原文/5[5]

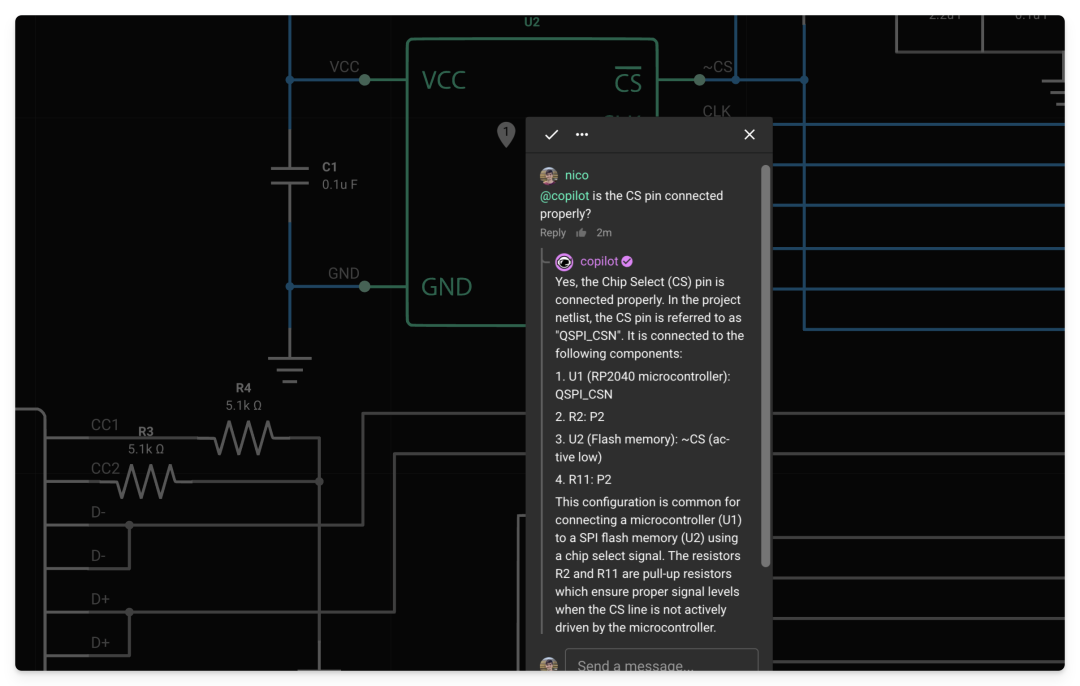

6. Flux.ai,让AI应用于硬件设计

Flux.ai的教程介绍了如何将人工智能应用于硬件设计,概述了将AI集成到设计过程中的潜在优势,如提高效率、准确性和创新性,同时还提供了实施这些技术的实用指南。

核心要点:

- AI可以在硬件设计中提高效率、准确性和创新性。

- Flux.ai提供了实践指南,帮助硬件设计师实现这些技术的应用。

- AI在硬件设计中的应用将成为未来的趋势。

标签:人工智能,硬件设计,Flux.ai

查看原文/6[6]

7. 人工智能接管编辑工作,作者借此契机探索新机遇

在人工智能写作机器人的崛起中,作者失去了一个利润丰厚的客户。尽管受挫,作者将其视为一个机会,探索新的企业,并与读者建立个人联系。在AI的新世界中,大多数人都不得不重新发明自己。

本文总结了以下三个核心观点:

- 作者失去了一个利润丰厚的客户,原因是人工智能写作机器人的出现。

- 尽管受到挫折,作者仍然看到了机遇,决定探索新的企业,并与读者建立个人联系。

- 在人工智能的新世界中,大多数人需要不断地学习和适应,以保持竞争力。

标签:人工智能, 写作机器人, 未来就业趋势

查看原文/7[7]

8. GitHub开源Next.js企业级项目

该仓库包含一个企业级的Next.js样板文件,用于构建高性能、易于维护的应用程序。它支持Tailwind CSS、TypeScript、ESLint、Prettier、测试工具等。该样板文件与ChatGPT集成,可以进行AI驱动的自动化代码审查。

核心要点

以下是该企业级Next.js样板文件的3个核心要点:

- 支持Tailwind CSS、TypeScript、ESLint、Prettier、测试工具等多种技术;

- 集成了ChatGPT,可以进行AI驱动的自动化代码审查;

- 具备企业级水平,可用于开发高性能、易于维护的应用程序。

标签:GitHub, Next.js, ChatGPT

查看原文/8[8]

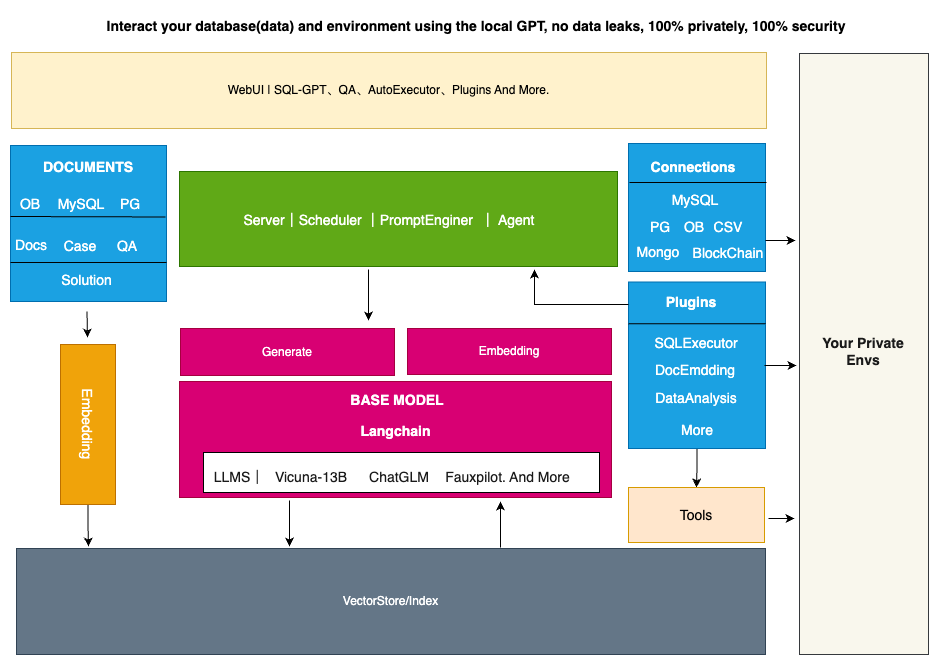

9. DB-GPT开源,在数据库场景下使用私有语言模型

DB-GPT是一个项目,旨在为所有数据库场景构建完整的私有语言模型解决方案。它旨在确保敏感数据和环境完全受控,以避免大型语言模型造成的数据隐私泄露或安全风险。DB-GPT支持本地部署,以确保模型始终是私有的、安全的和可控的。它使用本地化的GPT模型与数据进行交互。您可以通过链接查看演示视频。

核心要点

以下是该项目的三个核心要点:

- DB-GPT旨在为所有数据库场景构建完整的私有语言模型解决方案。

- DB-GPT支持本地部署,确保模型始终是私有的、安全的和可控的。

- DB-GPT使用本地化的GPT模型与数据进行交互。

标签:数据库, 私有语言模型, 数据隐私泄露

查看原文/9[9]

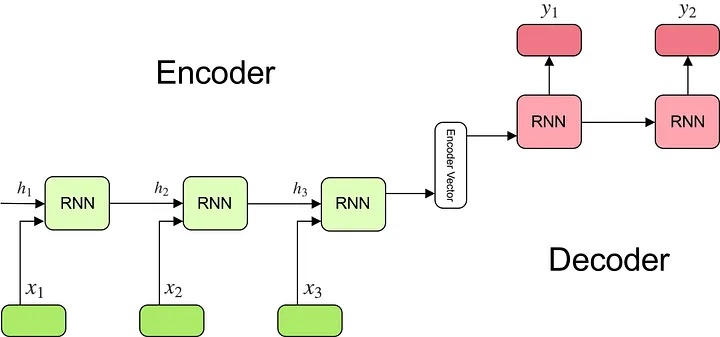

10. 探索注意力机制和Transformer技术

注意力机制和Transformer技术是现代语言模型更加高效的关键,本文将深入探讨它们的作用。

核心要点

- 注意力机制是一种机器学习技术,可使模型更加聚焦于输入中有用的部分。

- Transformer是一种基于注意力机制的深度学习模型,可以处理变长的序列数据,例如文本。

- 借助注意力机制和Transformer技术,现代语言模型可以更好地理解上下文,并生成更加准确的文本。

标签:人工智能, 机器学习, 自然语言处理

查看原文/10[10]

关注「漫话开发者」,不错过每天的全球AI头条,缓解你的“AI焦虑”,给每天AI前沿科技划重点!

其他开发者头条系列文章,定期独家干货放送:

- 开发者头条合集

- END -

参考资料

[1]

查看原文/1: https://ai.facebook.com/blog/multilingual-model-speech-recognition/?utm_source=talkingdev

[2]

查看原文/2: https://codi-gen.github.io/?utm_source=talkingdev

[3]

查看原文/3: https://wccftech.com/intel-aurora-genai-chatgpt-competitor-generative-ai-model-with-1-trillion-parameters/?utm_source=talkingdev

[4]

查看原文/4: https://github.com/piercefreeman/gpt-json?utm_source=talkingdev

[5]

查看原文/5: https://rl-diffusion.github.io/?utm_source=talkingdev

[6]

查看原文/6: https://docs.flux.ai/tutorials/ai-for-hardware-design?utm_source=talkingdev

[7]

查看原文/7: https://archive.is/9IDMC?utm_source=talkingdev

[8]

查看原文/8: https://github.com/Blazity/next-enterprise?utm_source=talkingdev

[9]

查看原文/9: https://github.com/csunny/DB-GPT?utm_source=talkingdev

[10]

查看原文/10: https://eugeneyan.com/writing/attention/?utm_source=talkingdev

鲁公网安备37020202000738号

鲁公网安备37020202000738号