美国人工智能公司OpenAI旗下的ChatGPT上线已经一年。近期,围绕OpenAI首席执行官萨姆·奥尔特曼去留问题的“宫斗剧”,短短几天内经历了“反转反转再反转”,似乎已经落下帷幕。

尘埃落定之后,OpenAI的首席执行官还是奥尔特曼,一切似乎没变,但一切似乎又已经完全变了。

这场大戏,揭开了OpenAI内部关于人工智能发展前途的矛盾,它暴露的不仅是一家人工智能公司的管理问题,更揭示了人工智能治理机制缺失的潜在风险。

作为全球知名的人工智能研究机构,OpenAI近年来一直是最受关注的科技公司之一。一年前,OpenAI推出大语言模型ChatGPT,掀起了生成式人工智能的热潮,奥尔特曼也成为全球科技界风云人物。

网络上流传的视频显示,奥尔特曼宣称自己没有公司股份,也不想通过公司商业获利。他还经常在公开场合宣称要警惕人工智能带来的风险。

而透过这场“宫斗戏”,人们发现事情远没有奥尔特曼宣称的那么简单。

美国有线电视新闻网报道说,董事会之所以“逼宫”,是因为担心奥尔特曼过于激进地推动人工智能开发,存在严重的风险隐患。据报道,奥尔特曼私下里在人工智能开发方面态度激进,试图推动公司更快把人工智能产品推向市场,通过销售产品获利。

根据路透社报道,此前有几名研究人员写信给OpenAI董事会,揭发一项名为"Q*"(发音为Q-Star)的“可能会威胁人类”的人工智能项目,引发了董事会的担忧和不满。据报道,该项目可能是OpenAI在通用人工智能领域的新突破。

什么是通用人工智能?OpenAI自己的定义是,在大多数具有经济价值的任务中,超越人类智慧的人工智能系统。简言之,就是能够取代人类大部分劳动的人工智能。

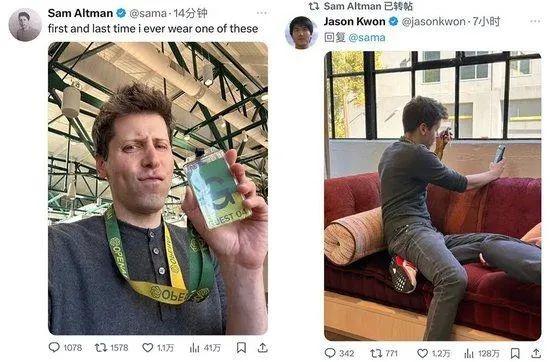

表面上,这场“宫斗戏”,是OpenAI首席执行官奥尔特曼与董事会之争;本质上,它是人工智能的冒险与稳妥之争。更愿意冒险的奥尔特曼胜出了。不久前,OpenAI在社交媒体X(推特)平台上称,该公司已“原则上达成协议”,让奥尔特曼重任OpenAI首席执行官,并组建新的董事会。

“宫斗戏”扑朔迷离,个中利益纠葛、恩怨情仇外人难以知晓,局中人的是非对错难以评判。这场大戏更值得人们关注和反思的,是人工智能领域关乎人类发展的严峻问题和潜在的漏洞风险。

单靠公司治理体制,不足以对人工智能实现有效监管;仅凭资本与市场的逻辑,难以有效遏制人工智能开发带来的潜在风险。

目前世界多国正在加强人工智能监管立法。欧盟正制定AI监管法规,法国、德国和意大利近期也就AI监管达成一致,支持AI基础模型“以行为准则方式强制自我监管”;美国10月30日发布首个人工智能监管行政命令,要求美国最强人工智能系统的研发人员需与政府分享其安全测试结果及其他关键信息等。

美国、英国等近20个国家11月26日公布一份建议性质的协议,一致认定企业需要在设计和使用人工智能系统时确保消费者等广大公众安全,需要监控滥用AI系统现象,防止数据遭干预,审核软件供应商资质等。

实际上,在OpenAI“宫斗剧”上演之前,中国10月18日就提出了《全球人工智能治理倡议》。这是中国在促进人工智能安全发展和应用方面作出的庄严承诺,为人工智能发展和治理问题提出了建设性的解决思路,也为相关各国讨论和规则制定提供了蓝本。

中国智慧和中国方案,为这个充满未知和风险的前沿领域,带来了更多的确定性和方向感。

或许,下次像ChatGPT这样的新突破横空出世时,人们除了新奇、惊艳,还会有更深刻、更长远、更多维度的见解与对策。

(读懂世界大事,请关注“伍之管见”微信公众号。)

来源:“伍之管见”微信公众号

鲁公网安备37020202000738号

鲁公网安备37020202000738号