时隔40天,全面对标Sora的中国首个自研视频大模型Vidu迎来重大进展。

6月6日消息,钛媒体AGI独家获悉,生数科技与清华大学联合发布的中国首个长时长、高一致性、高动态性视频大模型Vidu,近期完成三个最新、重大技术迭代,实现国内视频模型更大一步技术跨越。

- 1、目前Vidu可以一键生成32s视频;

- 2、支持音视频合成,即Vidu视频生成有声音了(Text-2-Audio)

- 3、支持4D生成,可以从单一视频生成时空一致的4D内容。

首先,在32s视频技术中,清华大学人工智能研究院副院长、生数科技首席科学家朱军教授6号下午现场展示了一段Vidu生成的画面。

这是一个图书馆书架放着的地球仪,它轻轻地旋转着,表面描绘的是地球的地图,相机逐渐拉近,地球仪表面剥开后,有一颗类似地球的蓝色星球。从现场放出效果看,32秒时长画面连贯,画面效果逼真,地球仪表面的地图信息也细颗粒度的复现,同时从“地球仪”到“内部蓝色星球”的动态转场也很好的实现。

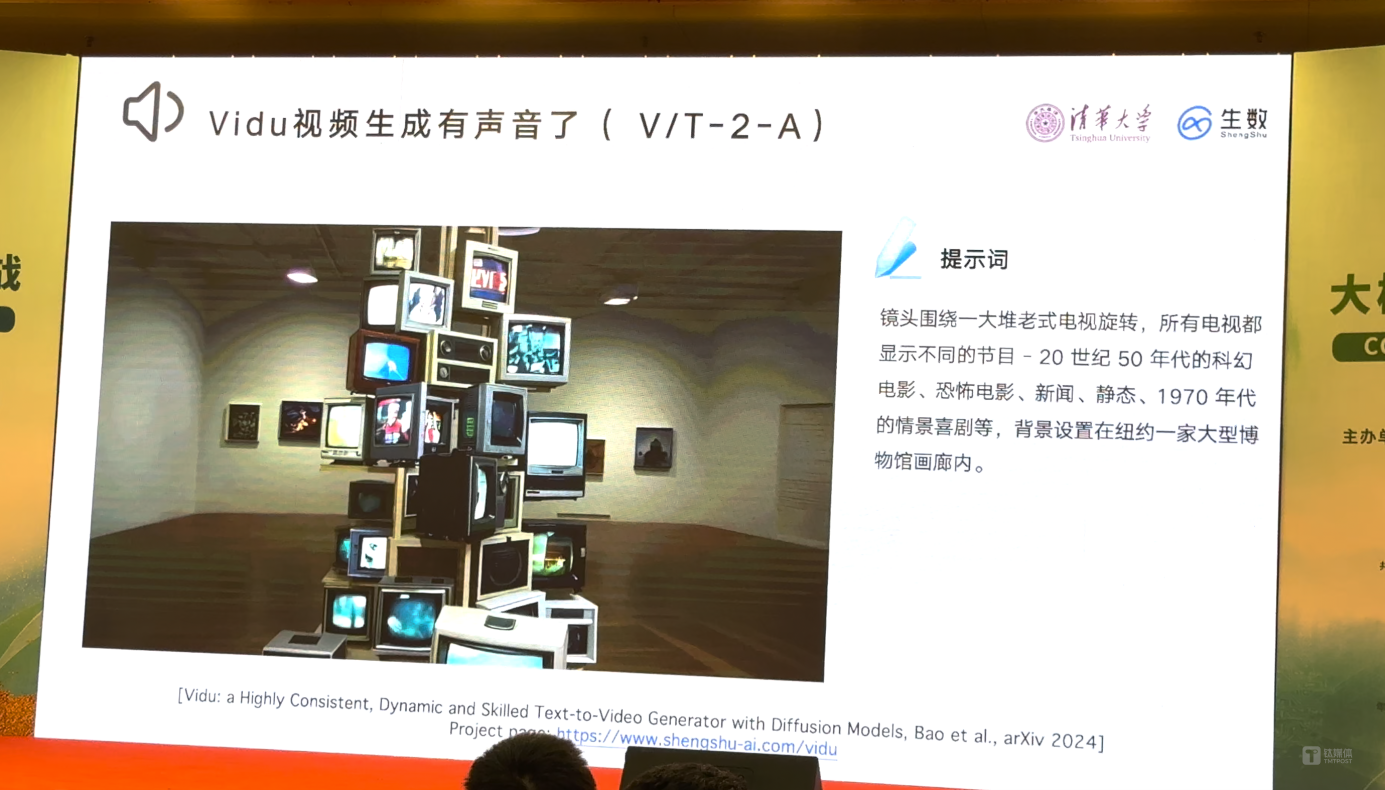

其次,现场展示了三段此前Vidu发布的Demo,但这次是“有声版”:

- 1、“画室里的一艘船驶向镜头”的片段,在强表现力、丰富想象力的画面之上,同步生成了背景音,包括海浪声、船的撞击声,声音自然,与画面高度匹配;

- 2、另一段“汽车在陡峭山坡上行驶”的片段。现场放出的配音版,能直观听到汽车发动机声音,以及轮胎在地面摩擦的声音,音画同步,包括能感受到森林环境的背景音;

- 3、还有一段是镜头围绕一大堆老式电视旋转,所有电视都显示不同的节目,20世纪50 年代的科幻电影、恐怖电影、新闻、静态、1970年代的情景喜剧等,背景设置在纽约一家大型博物馆画廊内。在声音效果上,该片段能够生成出嘈杂的环境和电视播放的声音内容,非常符合实际效果。

最后,Vidu4D层面,据了解,Vidu4D支持从单个生成的视频中精确重构出4D(即序列3D)。朱军表示,该项工作能有效提升视频生成模型效果,通过提升3D一致性,来增强视频生成对世界的真实模拟。

朱军表示,理论上底层架构支持任意时长的音频生成和匹配。而目前,生数科技官方还暂未放出正式的发布消息。但从现场效果来看,国产视频生成模型的时长天花板,在短短一个月后,再度被拉高至32秒。

相关论文已上线arXiv。论文地址:https://arxiv.org/abs/2405.16822

据悉,今年4月27日2024中关村论坛年会“未来人工智能先锋论坛”上,生数科技联合清华大学正式发布原创自研视频大模型Vidu,采用团队原创的Diffusion与Transformer融合的架构U-ViT。Vidu不仅能够模拟真实物理世界,还拥有丰富想象力,具备多镜头生成、时空一致性高等特点。而且作为中国自研视频大模型,Vidu还能理解中国元素,能够在视频中生成例如熊猫、龙等特有的中国元素。

实际上,Vidu背后的研发公司生数科技,其创始团队早在2021年就率先开始了扩散模型研究,是国内最早研究深度生成模型的团队之一。期间提出的免训练推断算法 Analytic-DPM、全球最快采样算法 DPM-Solver,被 Stable Diffusion、DALL·E 2 等图像模型采用,直接推动了全球图像生成浪潮的兴起。

2022年9月,团队提出全球首个 Diffusion 与 Transformer 融合架构 U-ViT,3个月后,伯克利团队发布了DiT架构,与U-ViT在技术思路、实验路径上完全一致,后被应用于Sora的研发,并在Sora发布之后获得广泛关注,而彼时生数科技对该技术路线的布局早已持续一年多。

短短半年后再次取得重大突破,开源全球首个基于此融合架构的多模态扩散模型 UniDiffuser,成功验证了大规模训练融合架构的可行性与涌现能力,并且入选了NeurIPS 2023。

今年2月OpenAI发布Sora之后,Vidu团队基于对U-ViT架构的深入理解以及长期积累的工程与数据经验,仅仅2个月的时间,突破长视频表示与处理关键技术,研发出Vidu视频大模型,显著提升视频的连贯性与动态性。

值得注意的是,与Sora一致,Vidu在底层算法实现上是基于单一模型完全端到端生成,不涉及中间的插帧和其他多步骤的处理。

“今年2月文生视频大模型Sora发布后,我们发现其刚好和我们的技术路线是高度一致的,这也让我们坚定地进一步推进了自己的研究。”朱军表示。所以,Vidu是自Sora发布之后,全球率先取得重大突破的视频大模型,也是国内唯一能够性能全面对标Sora的视频模型。

此次,时隔一个多月,Vidu模型再次实现重大技术迭代。

值得一提的是,6月5日,Vidu背后的研发公司,生数科技宣布完成数亿元 Pre-A 轮融资,由北京市人工智能产业投资基金、百度联合领投,中关村科学城公司等跟投,BV百度风投、启明创投等数位老股东继续支持。

据了解,生数科技拥有全链路自主研发、从零开始自主训练的“产业级”自研多模态大模型能力,提供图像生成、3D生成、视频生成的多模态生成能力,商业化方面布局MaaS(模型即服务)与应用级产品。

朱军团队透露,Vidu正朝着“更长时长”和“更多模态”的方向进化,并在短期内已快速取得了较好的阶段性效果。在视频生成之后,音频生成或将成为Vidu迭代的重点方向。

(本文首发于钛媒体App,作者|林志佳,编辑|胡润峰)

鲁公网安备37020202000738号

鲁公网安备37020202000738号