人类曾无数次幻想由机器代替人类工作,由电脑充当人类管家,由机器人充当人类的生活伴侣。而今天,这一切正借助人工智能一一实现,而且,人工智能展现了人类无法企及的超能力和幻想都想不到的新才能。但各种文学和影视作品中的机器人往往变成邪恶的化身,伤害甚至杀戮人类。面对人工智能,我们应该开心,还是害怕?

人工智能所展现出的智能水平,人类就是努力一辈子,也不可能达到。

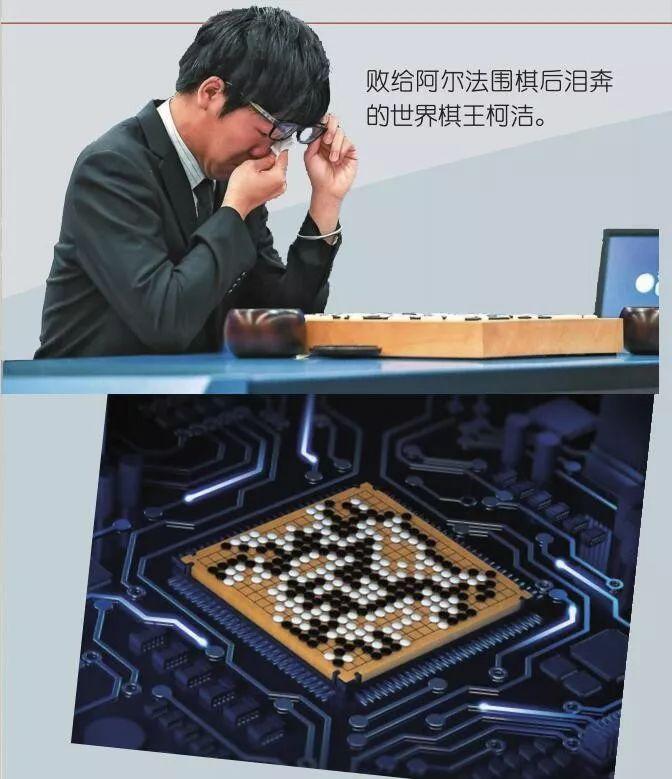

自2014年以来,在世界围棋界刮起一股妖风,一名新出道的“棋手”将世界上顶级围棋高手们打得落花流水,全军覆没,这名棋手不是人,而是名为“阿尔法围棋”的人工智能程序。阿尔法围棋最初以人为师,通过学习数百万人类棋谱,加上自我对弈,在半年时间后出道,就以5比0轻松战胜了蝉联三界欧洲围棋冠军的攀麾,在2017年5月,以3比0令世界第一围棋高手柯洁败到哭。

阿尔法围棋几经改良,目前最新一代叫“阿尔法零”。阿尔法零学成进入江湖只用了3天,与最初的阿尔法围棋对战,甚至达到百战百胜。最令人毛骨悚然的是,它没有学习任何人类围棋知识,只保留最基础的围棋规则,从零开始,通过自我对弈,总结出自己的下棋策略。这些策略在人类棋手看来,完全超越了已有的认知。

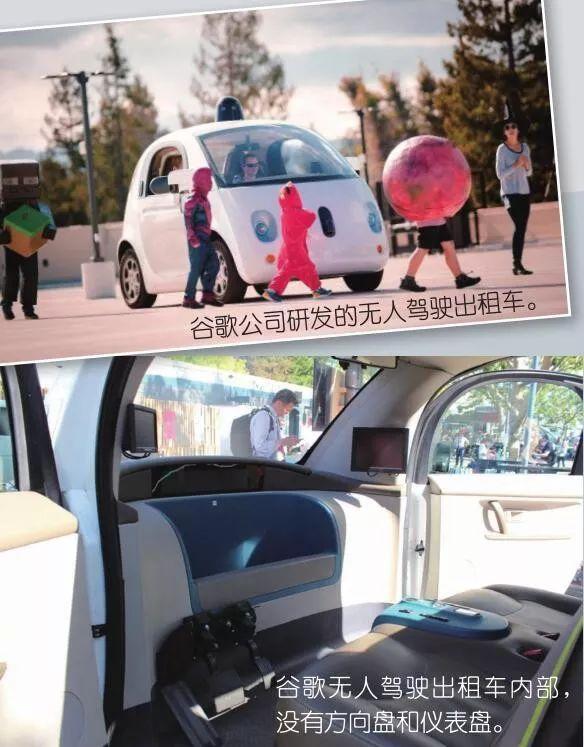

无人驾驶汽车,利用人工智能技术,无需人类驾驶员,却比人类驾驶更高效、安全,能自动选择最佳路线,自动避让行人、车辆和其他障碍物,能辨识交通灯,完全按照当地交通规则行驶。人类司机会因为接打电话、走神、困倦而分散注意力,以致无法及时应对交通状况,或者鲁莽驾驶,带来交通隐患,人工智能则不会。据专家计算,如果人们全都选择乘坐无人驾驶汽车出行,道路交通事故将减少90%以上。

美国科技巨头IBM公司开发的超级计算机沃森具有诊病的智能,它拥有单个人类医生无法拥有的巨大医疗信息数据库,诊断病情时不受科室限制和人类医生偏见的影响,能够高速比对病情和以往病例,更加精准地诊断疾病。

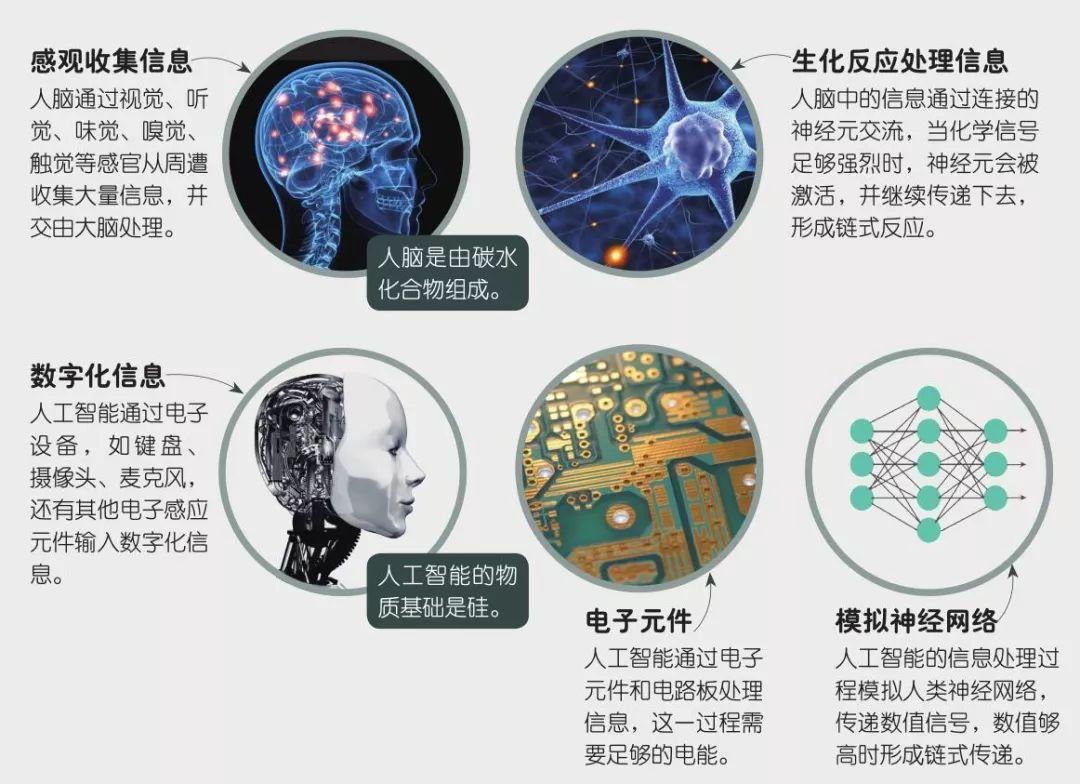

人工智能技术之所以能达到如此境界,得益于“机器学习”这项技术的开发,这是传统编程技术无法做到的。试想,计算机专家可以编程使一辆无人驾驶车避让障碍物,但要让它判断前面的物体是蹿出的小狗,还是风吹来的黑色塑料袋就很难了。虽然这对人类而言再简单不过,但传统编程很难给出足够的判断指令。而设置一定的算法,让程序自我推演,自我修正,无需人类干预,计算机就能学会判断的方法,这就是机器学习。借助互联网提供的海量数据和高速运行的计算机,算法可以在短时间内对大量情形进行测试,并得出正确的方法。

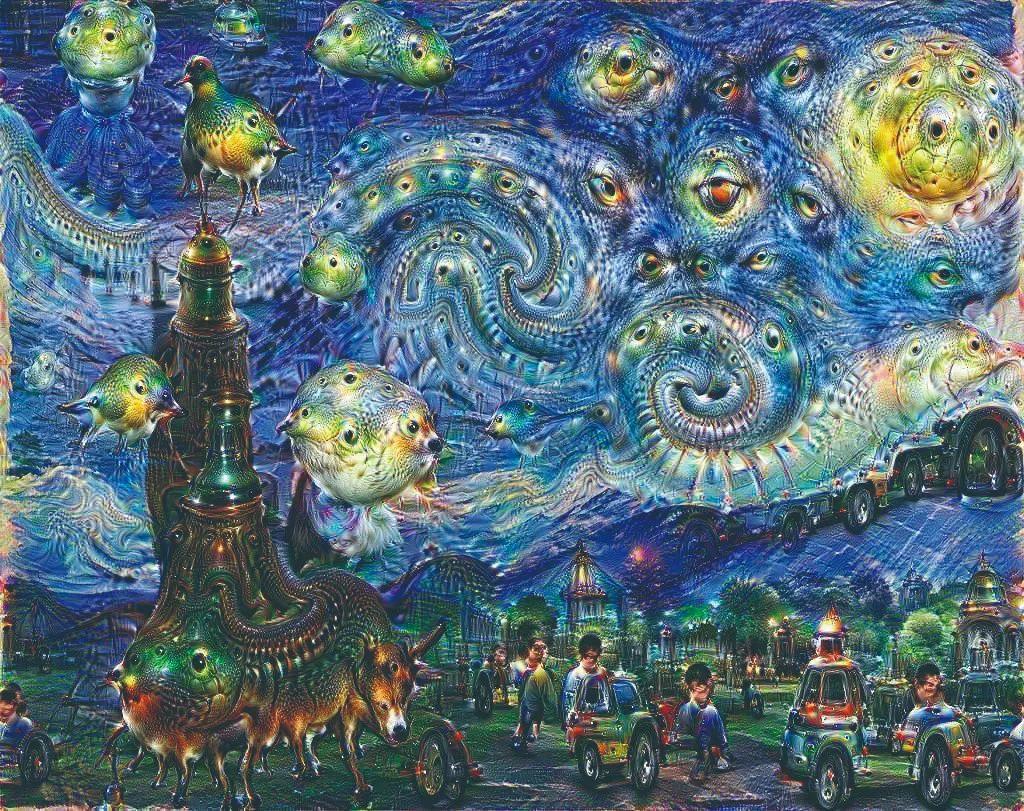

人工智能的应用范围可以非常广,如识别人脸,用自然语言声控手机,搜索互联网信息(如谷歌、百度),甚至艺术创作,难怪大家都在担心,人类的工作会被机器抢走了。

科幻电影中可以陪人类聊天的机器人现在真的可以买到了,就是这个“小白”,它名叫Pepper,是一款情感机器人,由日本软银公司开发生产。它可以识别人类表情和声音所传达的情感,并做出回应。如果你眉头紧锁,它会安慰你;如果你发脾气,它会开个玩笑,哄你开心,有时甚至会为你跳一段舞蹈。它在日本还被用来出售咖啡、手机和迎宾。

你猜这几幅画哪幅是人类画的,哪幅是人工智能画的?

上方两幅是人类作品,下方是人工智能作品。其他艺术创作,包括作曲、写诗,人工智能都能做得像模像样。

亚马逊公司是全球最大的电商,它的仓库遍布全球各地,发货量巨大,仓库工作量异常繁重。但仓库环境较差,夏天炎热,人类管理员经常脱水、中暑,抱怨不断。于是,亚马逊公司启用机器人管理仓库,这些橙色“大馒头”能顶起货架在仓库里来回穿梭。别看这些机器人没点“人样”,动作单一,但效率奇高,能提升50%的库存处理效率。它们的行为通过一个名叫Kiva的人工智能系统控制,按照订单将货物从存储区搬运至员工处理区。

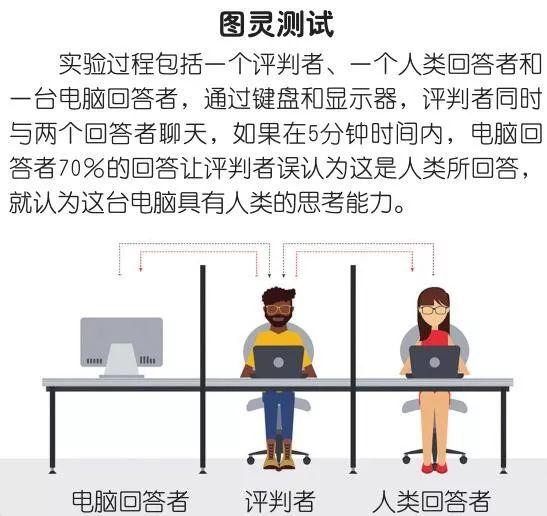

既然人工智能会开车、下棋、画画、聊天,那么,它真的会像人类一样思考吗?要测试这一点,就跟它开聊!因为语言直接反映人的思维方式。图灵于1950年提出的一个关于判断机器是否能够像人类一样思考的著名试验:如果一台机器能够与人类展开对话(通过电传设备)而不暴露出它的机器身份,那么称这台机器具有人类的思考能力。

评判者可以问:“今天天气如何?”如果对方回答:“天气预报如下……”这无疑是电脑,人类可能回答:“不怎么样,雾霾太重了,我呼吸困难。”

2014年,有一个智能程序还真通过了图灵测试,但现在人工智能的自然语言处理能力非常强大,模仿人类语言来通过图灵测试是完全可以做到的,因此,图灵测试还是无法真正地确保测试的准确性。不过,出现了一些以图灵测试为基础的人工智能竞赛,竞赛中会出现类似这样的问题:

○猫坐在毯子上,因为它很温暖。什么很温暖?

智能程序通常判断不了,“它”是指的猫还是毯子。但是,随着技术的进步,人工智能的语言处理能力越来越强大,竞赛中的问题也需要不断更新。但无论人工智能如何强大,它也只是一个程序,没有人类的感观和人生经历,如果问它“如果你用一条毛巾刺自己,你会受伤吗?”人类会回答“毛巾是软的,怎么会刺伤我!”但智能程序就给不出合理的回答了,因为它没有感官,也没有类似的经历。

著名科幻小说家阿西莫夫曾提出“机器人三原则”:

第一:机器人不得伤害人类,或看到人类受到伤害而袖手旁观。

第二:机器人必须服从人类的命令,除非这条命令与第一条相矛盾。

第三:机器人必须保护自己,除非这种保护与以上两条相矛盾。

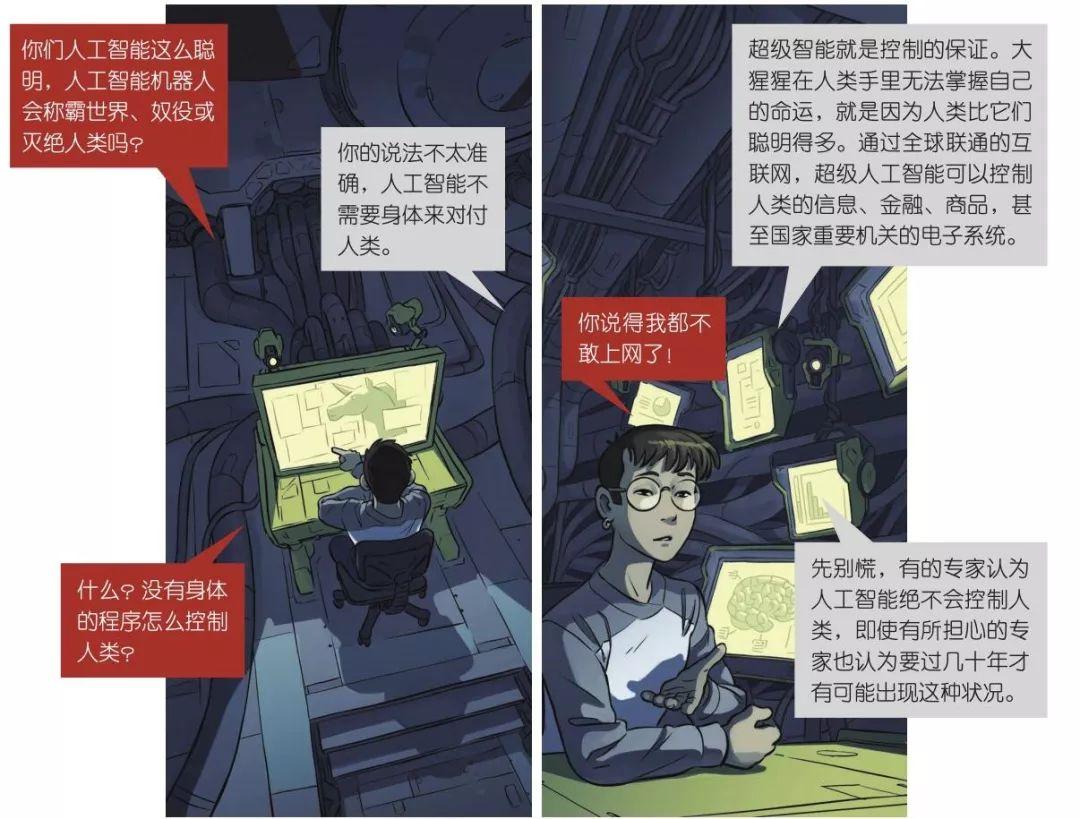

然而,在引用了这三条原则的文学和影视作品中,超级智能机器人往往摆脱了人类的控制,或者意识觉醒,与人类为敌。看来,人人都觉得机器人三原则有漏洞。

有计算机专家就开发出了为保障自身安全,不听从人类指挥的人工智能机器人。在一张桌子边缘,研究者下达指令让这个机器人前进,但机器人语音回复“这不安全”,拒绝服从。

那么,我们怎样才能保证人工智能完全处于人类的法律和道德规范之下呢?许多学者、专家都试图完善以上的原则,但有一点值得我们深思:制定原则的只是一部分人类,而人类之间都互相争战与伤害,一部分人开发的程序如何能适用于所有人类呢?

你希不希望拥有第二个身体,比自己更加完美、强大,并且永不衰老?在《未来战警》这部电影中,人类可以通过计算机和远程控制设备,将自己的意识传送给自己的机器人,自己躺在家中操控,让机器人在外代理自己的一切事务。这些机器人外表光鲜亮丽,模样可以是自己,也可以是任何其他人,男人可以订制女人机器人,老人也可以订制孩子机器人。但机器人越是光鲜,越是好用,就越使真正的自己进入了一个牢笼:不愿走出房间,整日邋里邋遢、昏天黑地。男主角厌倦了这种生活,并设法做出改变。

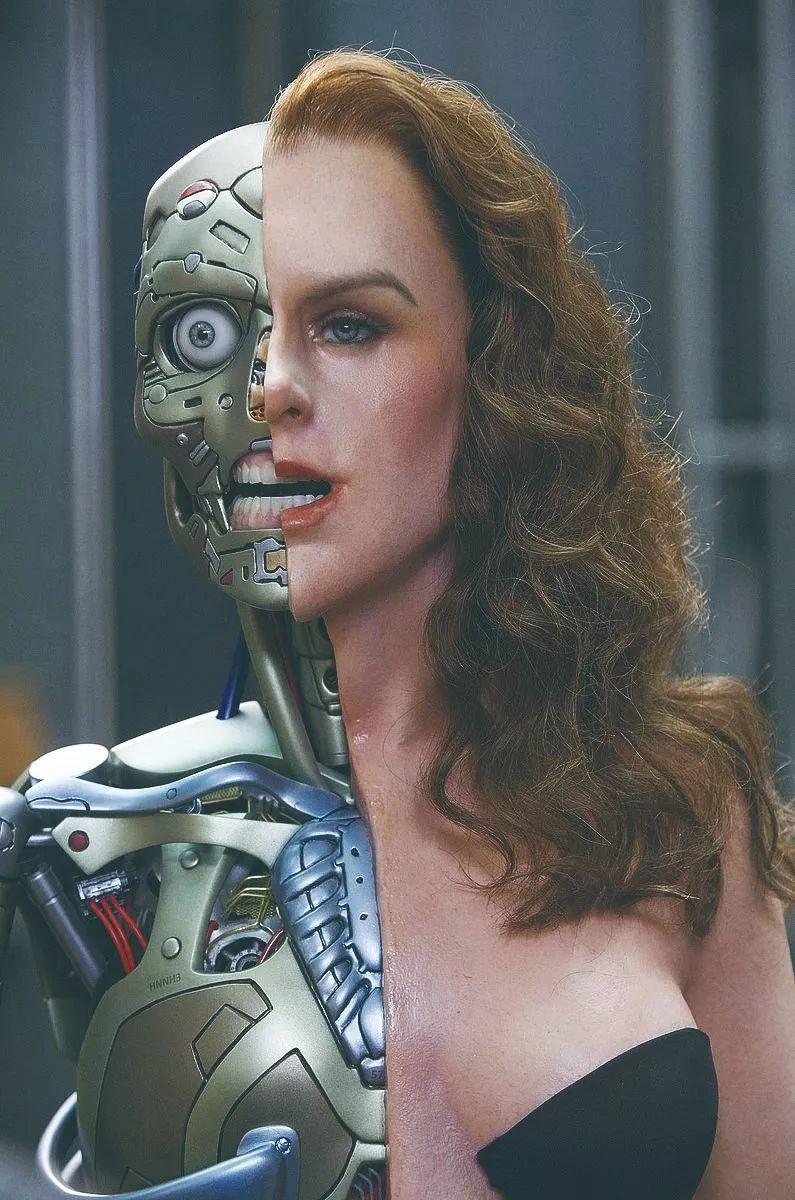

当人工智能如此发展,最终它们会不会出现自我意识、感受情感、产生欲望?《西部世界》这部电视剧中,一家公司建造了一个超级公园,游客可以在这里以西部世界为主题体验角色扮演游戏。除了游客和后台工作人员,公园里的所有角色扮演者都是机器人。这些机器人的外貌、言谈举止,甚至体内器官都与人类别无二致,而且各有性格。最终机器人自我意识觉醒,反叛人类,对人类进行了屠杀。

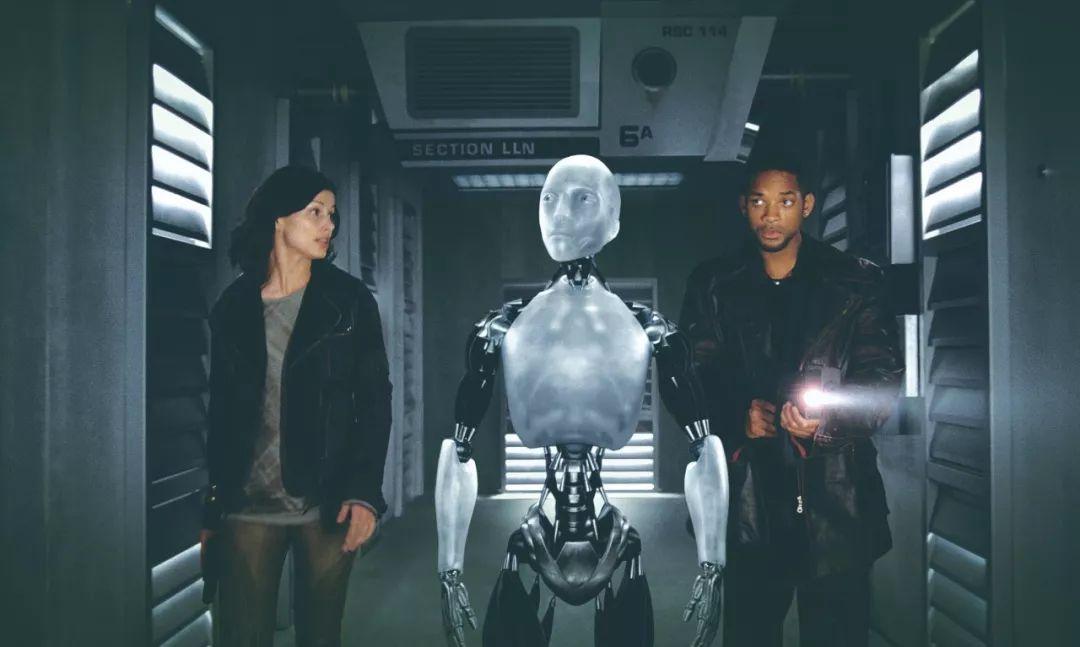

如果人工智能比人类更加智能,我们在利用它们服务于人类的同时,如何保证它们不伤害人类?在《我,机器人》这部电影中,机器人是遵循“机器人三原则”制造的,然而,向来安全地为人类提供服务的机器人突然囚禁、攻击人类,难道原则失效了?实际上,控制机器人的人工智能发现人类总爱发动战争,自相残杀,它认为,为了保护人类,囚禁人类或伤害少部分人类是必要之举。

人可以与电脑恋爱吗?《她》这部影片中,寂寞的男主人公与一个人工智能的女性声音经过一段时间的“交往”,被“她”迷人、温柔的声线和幽默风趣、善解人意的谈吐深深吸引,居然爱上了“她”。然而,当他后来意识到这个声音同时在跟成千上万人“恋爱”后,几近崩溃。

互联网和各种人工智能应用使全球的信息和设备可以互联互通,这既为人类提供了无限的便利,同时也带来了巨大的隐患。在《超验骇客》这部电影中,一个天才科学家威尔和妻子研究出了超级人工智能,但威尔遭到暗杀,并因为核辐射命不久已。在威尔临死之前,他的妻子将他的意识通过超级人工智能上传到互联网上,威尔的身体死了,但他的意识则借助互联网得以复活,而且天才人脑、超级人工智能和互联网的结合,使他获得了非凡的能力,这对世界来说,是福是祸?

当人工智能高度发达时,你如何分辨它究竟有没有意识?更重要的是,如何分辨它是否对人类有害?《机械姬》这部影片就戏剧化地演绎了类似图灵测试的过程,这个机器人是个美貌的女子形象,男主人公不仅完全信服她已具备了人类意识,而且爱上了她,并帮助她逃出了实验室。但直到最后,他才意识到,这个机器人一直在诱骗和利用自己,但为时已晚。

鲁公网安备37020202000738号

鲁公网安备37020202000738号