刚刚过去的2023年似乎要在人工智能的发展历史上留下浓重的一笔。受聊天机器人ChatGPT于2022年11月推出加持,2023年成为了人工智能发展史的一个转折点,甚至有媒体将其称为“人工智能元年”。

迈入2024年不久,推出ChatGPT才一年多的美国开放人工智能研究中心(OpenAI)又在人工智能视频生成领域抛出新花样,被业内视为人工智能技术的又一次进步。

近日,新京报记者对话美国西北大学计算机科学教授克里斯蒂安·哈蒙德(Kristian Hammond)。哈蒙德表示,可以说2023年是人们终于意识到人工智能的一年,而2024年将是人工智能整合之年,人们会想办法把这些新奇的“玩具”运用到生活之中。

谈及外界对人工智能快速发展的担忧,哈蒙德将构建人工智能想象成抚养一个孩子,希望它能比自己更聪明、更成功,同时不伤害任何人,努力打造人类和人工智能的伙伴关系,并肩战斗。

新京报记者对话美国西北大学计算机科学教授克里斯蒂安·哈蒙德。连线视频截图

“2024年将是人工智能整合之年”

新京报:许多媒体将过去一年称为“人工智能之年”,也有不少词典的年度词语都与人工智能相关。你会如何形容人工智能在2023年取得的进展?

哈蒙德:我认为2023年是人们意识到人工智能的一年,2024年将是人工智能整合的一年,在这一年里,我们会想出办法把这些闪亮、可爱、新奇的“玩具”用到我们的生活、业务之中,利用它们来造福人类。

新京报:纵观人工智能发展历史,有哪些重要的里程碑时刻?

哈蒙德:人工智能起步的时候,(人们)认为推理就像逻辑,我们必须写下所有的规则,但这点很难做到。后来我们遇到了一个关键转折点,发现机器学习可以帮助人们自动建立这些规则,但我们没有足够的数据,也没有足够的计算能力。

在获得了数据和计算能力后,我们来到了新的转折点,发现人工智能可以进行大量学习,学会如何控制自动驾驶的汽车,如何识别名字、面孔和物体,甚至别人的话语,还学会了如何翻转技术,预测图像可能是什么样子,人们的下一句话可能会说些什么。

我们已经看到了这个过程。事实上,归结起来这其中有两种推理系统。一种是非常快速的推理,不断识别人们在说什么内容。另一种是更慢、更留心的推理,试图弄懂他们说话背后的含义,以及自己应该相应做什么。接下来,我们需要弄清楚如何将这两种技术结合起来,它们都很强大,但是都不完善。

“网络上的任何事都离不开人工智能”

新京报:总体而言,截至目前人工智能给人类的生活带来了哪些机遇和变化?

哈蒙德:我们在网络上做的任何事情都离不开人工智能。例如,搜索引擎上会有人工智能组件预测你想要寻找的是什么,服务平台在提供信息、产品或进行推荐的时候,背后也都有人工智能的痕迹。所有与语音识别、面部识别有关的内容,也都有人工智能组件发挥作用。

有趣的是,我们开始思考如何把这些组成部分结合起来,看看它们都在做什么,哪些对我们有益,哪些有害。有时候我们可能会做出看上去非常有趣,但实际却产生危害的内容。识别出这些伤害并找出避免或补救它们的方法,这一点非常重要。因为我们希望人工智能与我们合作,我们不想生活在一个一切都已为我们做好的世界中,而是更希望与另一种智能形式共同工作生活。所以需要弄清楚人工智能的缺点与优点,并扬长避短。

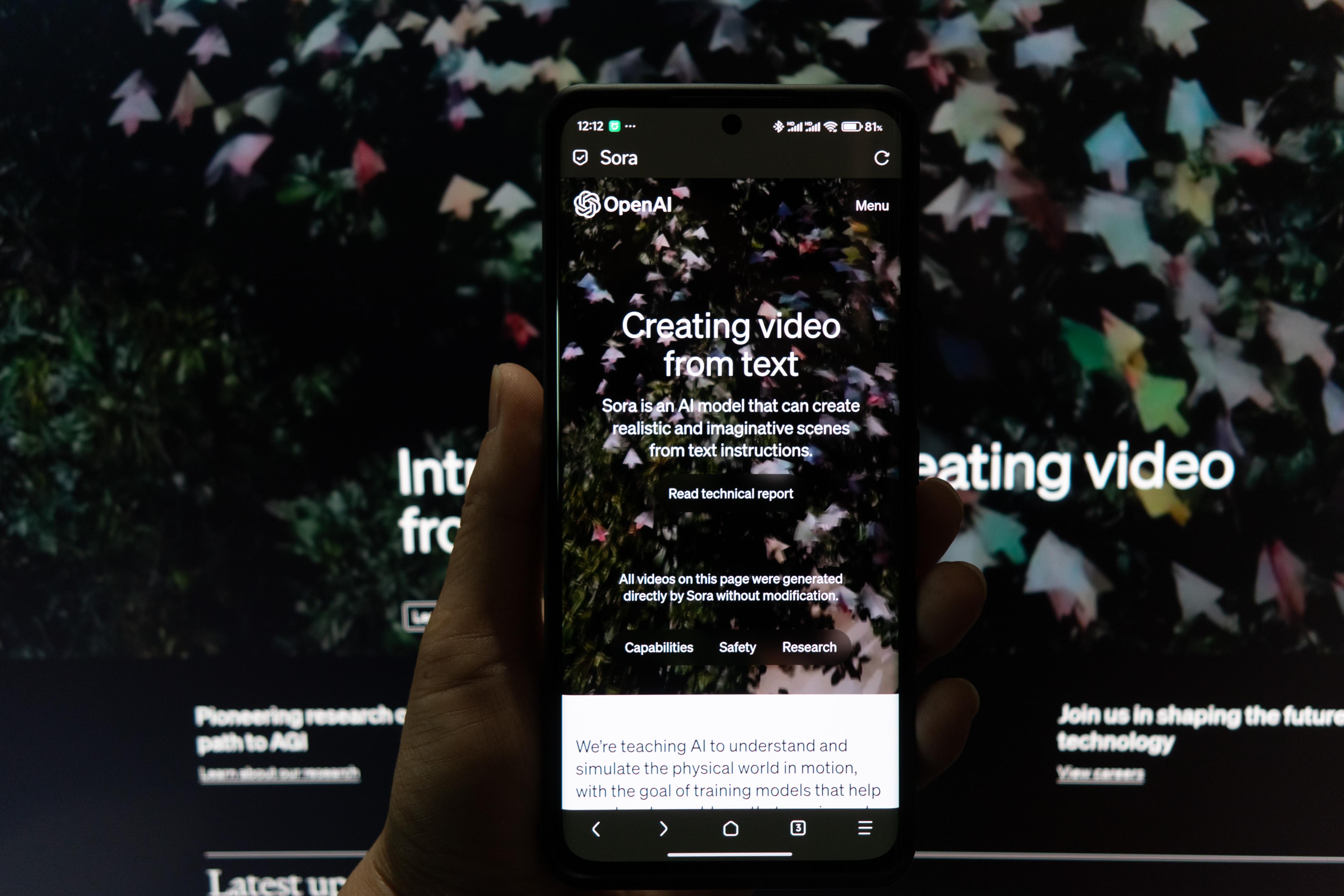

OpenAI公司即将推出文本生成视频产品Sora,引起全球关注。图/IC photo

新京报:伴随着人工智能带来的便利与机遇,同时也有潜在的风险。你刚才提到的看上去十分有趣的人工智能也可能会在一定程度上产生有害影响,能否展开讲讲其可能带来的挑战?

哈蒙德:例如,在视频制作之中,使用技术将各部分合并在同一个屏幕之上,这在一定程度上给我们带来了一个深度造假的世界。就制造冒犯性材料而言,可能把某个人放入某段色情视频之中,这可能是非常危险的。或者有人通过某些技术加入一个视频会议,假装是在场人员的上司,试图说服其他人将钱转到另外的账户里。人工智能也可能卷入世界重大事件和政治之中,它创造出的图像并不是真实的,却十分令人信服,这意味着我们将生活在一个我们不再确定什么是真实的世界之中。

还有其他技术虽然吸引人,令人欲罢不能,但也可能产生负面影响。例如,我们生活在一个社交媒体的世界里,但在这里似乎每个人都比我们更加漂亮、更加富有,比我们做得更好,这会在一定程度上导致抑郁。

我们已经应用了一系列人工智能相关的技术,现在是我们认真看待它们的时候了,找出我们哪里犯了错误,然后改正它们。我们想要的不是一个无法离线的世界、让我们感到沮丧的世界,更不是一个被谎言包围的世界。

“未来应规范恶意使用,防止技术遭滥用”

新京报:人工智能公司也意识到其潜在的风险,试图打造工具帮助监测虚假误导内容。然而,有专家担心总会有人找到办法绕过这些屏障。在你看来,能否完全阻止人工智能技术被滥用?

哈蒙德:这不可能做到,我们必须意识到这一点。例如从Photoshop的角度来讲,它的出现意味着我们可以修饰照片,改变过去的记录,以及改变对过去所发生事情的理解。逐渐我们习惯了它的概念,习惯了在看一张图片的时候会评估它是否合乎常理。

对于所有人来说,我们必须培养一种批判的眼光,意识到出现在我们面前的东西可能并不真实,并弄清楚我们如何为自己提供真正的批判的工具、人性的工具、思考的工具来识别这种情况,避免被欺骗。

新京报:2023年召开了首届人工智能安全峰会、欧盟通过了全球首部人工智能法。你如何评价目前全球对于人工智能使用的监管水平?接下来还需要做哪些工作?

哈蒙德:我个人认为欧盟的做法很好。他们很少考虑这种技术或那种技术的本质,而是更多地考虑风险,找出风险所在,并建立风险的等级机制。如果涉及有关人类生命的决定,那么这就是一个非常高风险的情况,因此会在算法、数据和使用方面提出更多要求。

例如,我个人并不想让所有的公共摄像头一直追踪自己的位置,我想有自己的隐私,但如果我的孩子失踪了,我希望每一台相机中的每一帧图像都得到使用,看我们能否找到他们。这就是问题所在,技术可以有各种不同的用途,其中一些非常重要,对人类有益,其他则并非如此,需要监管的是其中的差异。随着技术的发展,它会变得更好、更快、更强,将可以在越来越小的机器上运行,我们无法避免这种情况,但我们可以通过规范恶意使用来避免它被滥用。

当地时间2024年1月24日,德国柏林医院展示人工智能支持的放射治疗,可提供更精确的放射线,从而更有效地治疗肿瘤,并将副作用降至最低。图/IC photo

“应打造人类与人工智能的伙伴关系”

新京报:谈到人工智能,一个总会被提及的问题是,人工智能是否会在未来取代人类的工作。长期而言,你如何看待人与人工智能之间的关系?

哈蒙德:从长远来看,人类认知的方方面面都可以运用到机器上,也就是说,我们会让机器变得和我们一样聪明、有创造力以及有直觉。我们从不认为身边有聪明人是件坏事,我们喜欢这样,换成智能机器,我们的态度也应该是一样的。

我喜欢把构建人工智能想象成抚养一个孩子,我们当然希望孩子比自己更聪明、更成功,也希望这个孩子不要伤害别人,如果能做到这三点,那就太棒了。打造人工智能时,要意识到它将与我们并肩作战,我们必须思考该如何让人工智能系统与我们保持一致,与我们合作。

我无法想象人工智能会在人类没有提前设定计划的情况下,消灭一切工作或试图接管一切,当然我们也不应该给人工智能发出这样的指令。我们应该打造的是人类与人工智能之间的伙伴关系,我们可以建立一个为彼此做更多事情的世界,如果我们花更少的时间劳动,仍然过着美好的生活,关注兄弟姐妹的需要,那将会是一个多么美好的世界,而这正是人工智能可以构建的世界。

新京报:在你看来,人工智能将会走得多远?

哈蒙德:我不能给出一个准确的时间表,我们正在(为人工智能)打造人类水平的认知技能,但这也不是终点。人类也是同样,我们一直在努力变得越来越好,想让下一代更健康、更聪明,这也是人工智能世界的感觉,它将变得越来越智能,人类与人工智能一起工作,共同把事情完成,互相照顾彼此。

新京报记者 栾若曦

编辑 张磊 校对 吴兴发

鲁公网安备37020202000738号

鲁公网安备37020202000738号