(报告出品方:中信证券)

市场回顾:美股科技板块、算力板块领涨

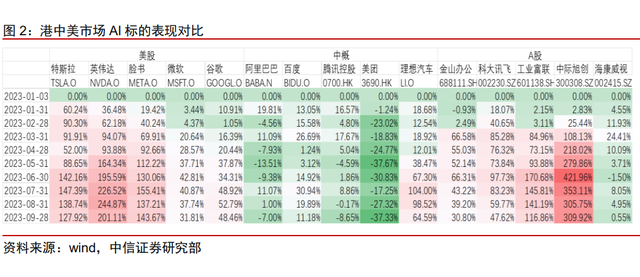

随着 ChatGPT 以及 AI 的持续发展,全球投资者对人工智能期待甚多,资本市场亦在 寻找相关领域的投资机会。复盘 2023 年全球主要资本市场走势,我们看到几个明显的特 征:1)投资机遇主要围绕算力领域,英伟达及其产业链公司领涨,例如美股市场上英伟 达,A 股市场的工业富联、中际旭创等。2)从市场类别看,美股纳斯达克(+27.9%)和 费城半导体(+36.8%)指数领涨。中国人工智能和科技相关指数表现平淡。

具体来看,截至 9 月 28 日,A 股市场,中信半导体指数(-5.3%)下跌,中信电子指 数(1.3%)和中信计算机指数(+8.4%)小幅上涨。港股恒生科技指数(-10.8%),表现 略强于恒生指数(-13.8%)。个股方面,英伟达(+201.1%)、脸书(+143.7%)、特斯拉 (+127.9%)领涨美股,英伟达产业链公司中继旭创(+309.9%)、工业富联(+116.9%) 领涨 A 股,理想汽车(+64.6%)表现显著优于其他港股科网公司。

虽然市场上已经反映了大量的 AI 预期,但在当前技术和应用仍在快速迭代的过程中, 投资者依旧关注:1)英伟达及其产业链公司的股价是否已经 Price In 太多市场预期,是 否还有上行动力;2)人工智能投资机会未来是否将进一步向算力领域外延伸,云计算、 大模型、AI 应用领域投资能否酝酿下一波投资机遇。在本篇报告中,我们将系统性总结、 反思过去一年乃至更长时间周期内,AI 的演进及市场预期变化,梳理人工智能的投资框架 全景图,全面梳理 A 股、港股、美股市场上的人工智能相关公司,供投资者参考。

技术逻辑:走向更人性化、更多元化的人机交互模式

技术复盘:OpenAI 主导的生成式人工智能 AIGC 路径,建立在超大规模的数据学习 基础上,基于模型训练和 RLHF 人类反馈强化学习,可用于文本、图片、代码等多模态信 息生成和交互。而 ChatGPT 的技术根基来自于 2016 发表的 Transformer 模型(由谷歌最 先提出),用通俗的语言来解释,这一模型的工作就是通过分析数据单字间的统计学关联, 从而预测句子中将要出现的下一个词或者空缺的词的概率。通过不断计算空缺单词的概率 分布,模型最终通过统计学的原理生成出一个完整的句子。

回顾 OpenAI 的发展历程,ChatGPT 的成功并非是横空出世,而是经历了超过 7 年、 多于三代的技术积累与迭代,并在这一过程中走出了自己的开创性道路。

OpenAI 成立于 2015 年,在当时的学术界仍然以深度学习为核心的小模型占据主流: 这类模型以 LSTM 及 CNN 模型作为典型的特征抽取器,根据特定领域标注数据训练,在 一些任务上可以达到接近人类的水准。但是硬件算力不够导致针对其他领域重新训练成本 过高,让其通用型任务的完成情况很差。

从 2018 年开始,OpenAI 开始活跃在大语言模型的学术圈内,并提出了开创性的 GPT-2 模型。2017 年谷歌 Bert 为代表的双向预训练+Fine Tuning(微调)的 Transformer 模型横空出世成为了人工智能的主流方向,OpenAI 紧随谷歌之后提出了 GPT-2 在 Bert 的模式上做了改进,以让其更适合生成式的任务。尽管 GPT-2 模型仍然十分不完善,基准 成绩不算优秀,但 Bert与后续 GPT-2等模型的推出统一了自然语言模型(NLP)的研究范式。这类模型以预训练的方式学习语言学特征,大幅简化了过去 NLP 繁琐的研究种类。 Transformer 作为特征提取器效果好于 CNN、LSTM 模型等,让 AI 首次能在语言任务的部 分场景中追平人类。

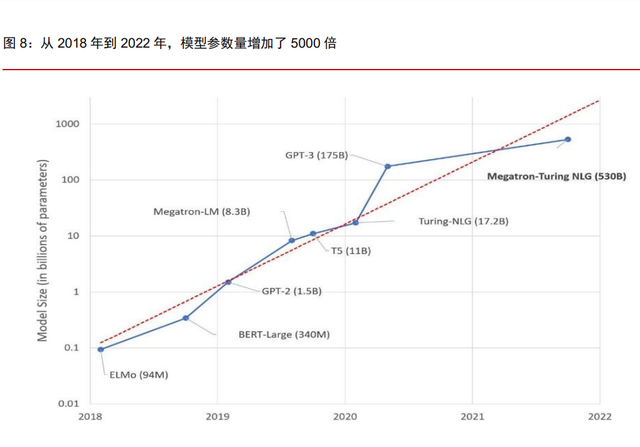

2020 年是 OpenAI 产生广泛影响力的开端,GPT-3 的出现证明了 OpenAI 自回归模 型的优势,并验证了模型大小与数据质量的重要性。在这段时间内产业界与学术界继续沿 着 Transformer 的道路前进,但开始尝试不同于 Bert 的其他 Transformer 架构,通过预训 练无监督学习的方法不断增加模型大小成为了这一时段的主流。以 OpenAI 1750 亿参数的 GPT-3 为代表,各大互联网巨头不断尝试增加模型体积以获得更好的效果。

GPT 模型相比于其他模型的不同之处在于其更好的产品化能力。相比于 Bert,GPT-3 的自回归+Prompting 在产品化能力上展现出了两个优点:1)Fine-tuning 对于小公司更难 部署,从产品化的角度上更加困难;2)Prompting 的方法更符合我们对以人类的方式使用 AI 的愿望。谷歌等巨头在这一阶段也意识到了 Prompting 方法的重要性,逐渐开始转向。 国内 AI 研究在这一段时间内明显落后,仍然沿着 Bert 模型的方向继续前进,对 GPT-3 的 研究很少;同时受制于中文优质语料的相对稀缺,模型大小也较难提升。

ChatGPT 的成功证明了 GPT 模型的 Prompting 道路的正确性,同时也强调了数据 质量的重要性。ChatGPT 最重要的成功是在产品化上更进一步:ChatGPT 在模型精度上 并没有飞跃性的突破,但从 Few Shot prompt(需要输入范例示范)转换到 Instruct(用人 类语言描述想做什么)更加贴合用户的习惯。

从产品逻辑上,ChatGPT 的 Prompting 模式虽然牺牲了部分精度,但无需用任务区 分器区别不同的任务,更接近于大众所理解的“人工智能”。此前大众接触的人工智能 如·Siri、小爱、小度音箱等,通过以任务分类的形式运行,准备不同任务的标注数据分别 进行训练,是传统的 Bert 类模型。简单来说,将预先设置好的任务类型放于模型背后,使 用者通过描述任务类型系统来匹配对应的模块,缺点是使用者的指令需要清晰且无法执行 没有预先设置的任务类型。而 GPT 类模型面对用户不同的输入,模型可以自行判断给了 用户更好的体验,这也更接近于大众理解的“通用人工智能”。

随着 GPT 模型的成功,OpenAI 等人工智能头部厂商从开源走向闭源,利用其资源 优势来打造差异化的 AI 模型。在 GPT 与 PalM 交出出色表现后,谷歌与 OpenAI 作为行 业内的技术领先者已经明确选择了闭源模式:OpenAI 推出 GPT-4 的形式与以往模型的发 布都有所不同,OpenAI 既没有公开发布 GPT-4 的相关论文,也没有提供详细的框架说明, 仅仅提供了一份 98 页的技术文档(主要描述模型能力以及相关评测的得分,几乎没有任 何技术细节)。通过这一方式,OpenAI 阻断了所有借鉴者参考的直接途径(模型大小、数 据集构建、训练方法等),将闭源的路线坚持到底。通过这一方式,OpenAI 迫使想要融入 GPT-4 能力的软件服务商与其合作,OpenAI 提供对应的 API 接口以及部署指导。

相较于头部厂商,Meta 等追赶者更倾向于培养开源社区,发布 Llama2 共同迭代模 型。头部厂商闭源模型后,落后一到两个身位的公司(Meta、Amazon、NVIDIA 等)可 能会选择开源路线,寄希望通过社区的力量加速迭代。2023 年 7 月 19 日,Meta 发布了 其最新开源可商用版本 Llama2 大语言模型。模型层面的最大亮点在于开源了与 GPT-3.5 相同的 SFT 与 RLHF(人类反馈强化学习)的步骤,成为目前开源类别中最接近 GPT-3.5 的大语言模型。从 Meta 论文中公布的数据指标,Llama2 70B 在部分指标上甚至追平了 GPT-3.5,大部分指标超过 GPT-3,成为如今性能较为领先的开源模型之一。总体来看, Meta 的 LLaMA2 论文向业内拆解了 SFT 以及 RLHF 等的技术过程,并给出了可以直接使 用的版本,我们认为这将会统一目前开源领域的研究框架,加速开源模型的迭代速度。

除去上述提到的几家互联网巨头外,海外的初创模型公司中也有如 Anthropic、Cohere 以及 Adept 等市场参与者:

Anthropic

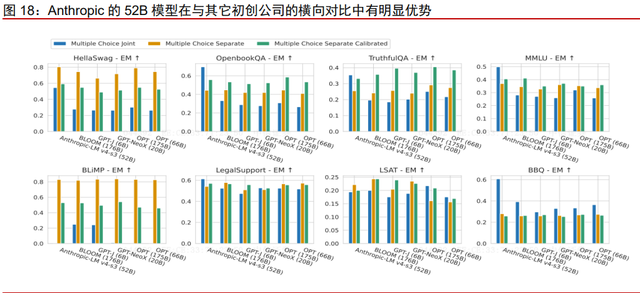

Anthropic 是由 OpenAI 前员工 Daniela Amodei 和 Dario Amodei 创办,他们是 GPT2 和 GPT3 的核心研发人员。在 ChatGPT 发布两个月后,Anthropic 公司就迅速开发出了竞 品 Claude,又在 2023 年 7 月初完成了 Claude 2 的升级。相比初代版本,Claude 2 性能 有所提升,并且能够实现更长文本的响应,在编程、数学、推理等方面都有大幅提升。根 据其论文公布的相关参数,Claude 2 在一些核心数据集中的表现可以与 GPT-3.5 相当。

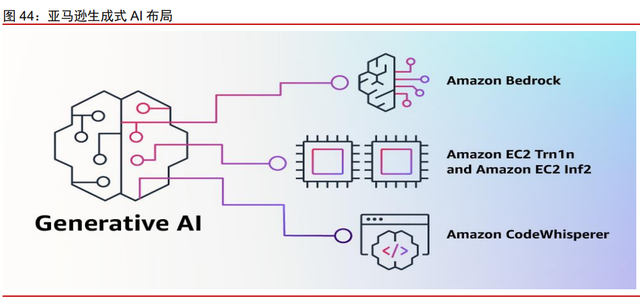

依托亚马逊硬件平台,寻求快速扩大模型规模。根据 TechCrunch 的报道,Anthropic 的目标是在未来两年内筹集多达 50 亿美元,以训练一个强大的模型,并进入十几个主要 行业。作为 OpenAI 的挑战者,Anthropic 在 2022 年早些时候获得了谷歌 4 亿美元的投资, 并于 2023年获得亚马逊 40亿美元的初期投资。根据亚马逊的披露,通过与亚马逊的合作, Anthropic 将使用 AWS Trainium 和 Inferentia 芯片来构建、训练和部署其未来的基础模 型。并且,两家公司还将合作开发未来的 Trainium 和 Inferentia 技术。

Cohere

Cohere2019 年成立于加拿大多伦多,其创立者 Aiden Gomez 是 2017 年大模型的开 创论文《Attention is all you need》的署名八位作者之一。这 8 位作者均已离开谷歌,其 中 6 人选择创建自己的 AI 公司,分别是 Cohere、Adept、Character.ai、Inceptive 以及 NEAR.AI。Gomez 创立的 Cohere 主要业务是给用户提供应用大语言模型的 API,可以帮 助用户创建针对客户特有的使用场景和独有数据的大模型。Cohere 可以提供生成语言模 型 ( generativelanguagemodel , 如 GPT2 和 GPT3 直 接 生 成 文 字 ) 和 表 示 模 型(

reprensentationlanguagemodel,如 BERT,生成 Embedding 向量)。在 2023 年中端 大模型竞争愈发激烈后,Cohere 也改变此前不单独推出模型的战略,发布了其协同类助 手 Coral,主要针对的是办公场景中不同工作流的协同任务。

Cohere 在 2021 年 9 月获得 4000 万美元 A 轮融资;2022 年 2 月获得 1.59 亿美元 B 轮融资,投资方包括 AI 领域资深学者深度学习三巨头之一 Geoffrey Hinton、李飞飞、Pieter Abbeel,还有知名基金 TigerGlobal,IndexVenture 等。2023 年 5 月获得 2.5 亿美元的融 资,估值达到 20 亿美元,投资方包括 SalesforceVentures,英伟达,InoviaCapital 和 IndexVentures 等。

Adept

Adept 成立于 2022 年,专注于人工智能模型开发领域,其创始人是之前提到的论文 《Attention is all you need》另外两位作者 Ashish Vaswani 和 Niki Parmar。截至 2023 年 3 月,Adept 累计融资 4.15 亿美元,最新的估值至少为 10 亿美元。Adept AI 目前的主 要目标是基于生成式 AI 技术来做的一款通用操作工具,让用户可以通过使用语音或文字来 下指令,由人工智能理解后来帮助完成各种操作和任务。Adept 的产品更接近于 AI Agent 的概念,这也导致他目前的实际落地进度较慢。简单来说,Adept AI 的目标是基于生成式 AI 来建立一个全新的操作系统或者说是平台,彻底改变过去人们使用应用程序或网页来进 行软件操作的流程。目前,该产品主要由 Adept AI 自研的大模型 Action Transformer (ACT-1)来实现。

国产大模型:诸多玩家入场,科网巨头目前投入较为激进。国内市场亦与海外市场类 似,大量科技互联网巨头、初创公司参与到竞争当中。从类型来看,主要分为四类玩家: 1)科技互联网巨头,以 BATT、华为等为代表,力争实现通用模型的建设。2)初创公司, 以 Minimax 等为代表,独立创业进行大模型的研发。3)科研院校,围绕科研资源,进行 大模型的研发。4)其他科技公司,如云知声、科大讯飞、昆仑万维等。

应用潜力:AI+SaaS 将成为最有潜力的模式

目前的 AI 应用端尚不成熟,我们认为 AI Agent 将会是 AI 浪潮的下一个风口机会。 通过将语言模型与外部记忆规划工具结合,AI Agent 进一步简化了交互难度并提高稳定性。 OpenAI 的应用研究主管 LiLian Weng 在接受采访时表示 Agent 是大语言模型+记忆+规划 +外部工具的集合体,其中大语言模型是整个系统的大脑。通过一些列的封装操作以及对 外部数据的引用,Agent 能够极大程度减轻幻觉所带来的错误问题。业界认为到目前为止, Agent 仍然是一个理想中的概念,实际产品仍然受到目前较慢的算力传输、高昂的成本以 及难以互通的外部 API 的限制,但在未来 3-5 年后 Agent 最终可能成为 ToC 领域,人机交 互的入口级平台。

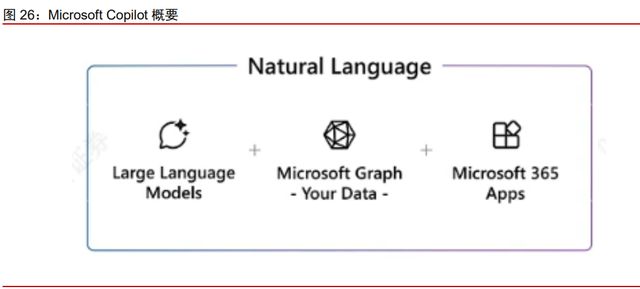

微软 Copilot AI 助手是目前进度最快的 Agent 产品,通过整合 GPT 技术,有助提升 用户效率,且有助公司挖掘用户价值。Copilot 是微软生成式的 AI 助手,此前已被应用在 类似于 Github 等代码开发场景。根据微软在其技术文档中的表示,Copilot 采用了 OpenAI 推出的 GPT-4 模型,并且进一步优化了输出内容的可靠性以及使用数据的隐私问题,为企 业级的应用做好了准备。AI 功能被直接集成到 Word、Excel、PowerPoint、Outlook 和 Teams 等应用中,用户可以提出问题并提示 AI 撰写草稿、制作演示文稿、编辑电子邮件、制作演 示文稿、总结会议等。Copilot 将以两种方式与 Microsoft 365 客户合作:1)嵌入到 Word, Excel,PowerPoint,Outlook,Teams 等。2)提供聊天功能。商务聊天功能覆盖 LLM、 Microsoft 365 应用和客户的日历、电子邮件、聊天、文档、会议和联系人工作等,通过 自然语言提示(如“告诉我的团队我们如何更新产品策略”),商务聊天将根据上午的会议、 电子邮件和聊天线程生成状态更新。Copilot 最早基于 Windows11,后支持 Office365,面 向企业用户定价为每用户 30 美元/月。我们认为,微软 Copilot 是最值得关注的 AI 应用,如果其订阅数据保持持续稳定增长,意味着 SaaS+AI 商业模式被用户接受,具有显著的 示范效应。

业务逻辑:实现应用、数据、模型的业务闭环。在 Copilot 的业务逻辑中,从用户的 输入到最终模型完成并自我迭代大约有以下流程:1)由用户给出实际需求的 prompt,微 软根据已经授权获取的用户数据图谱当中,提取所需数据。2)将数据以及识别后的 prompt 输入至语言模型。3)由语言模型处理,并进行多模态的关联落地(grounding),返回至 用户的数据图谱。4)基于用户的数据图谱,返回至应用,完成输出以及命令的执行。

关联落地(Grounding)是 Copilot 在用户级别对于指令的微调,是确保大语言模型 生成的内容可靠的关键步骤。根据微软在其公开的技术文档中的表述,Copilot 将会通过 Grounding 这一过程来提高其接收提示的质量,以确保模型最大程度上准确执行用户的指 令。如果用户要求 Word 根据相应的数据创建文档,Copilot 会将该提示发送到 Microsoft Graph 以检索上下文和数据,然后修改并优化用户的提示(例如加入用户真实业务场景的 数据的示例以提高准确性)并将其发送到 GPT-4 大语言模型。响应结果然后被发送到 Microsoft Graph 进行额外的 Grounding、安全性和合规性检查,最后将响应和命令发送回 Microsoft 365 应用程序。通过 Grounding 这一过程,Copilot 本质上将人类语言的表述根 据实际的数据情况更换成更符合大语言模型理解的 Prompting(提示),然后以此完成多模 态之间的转换并提升指令的准确性。

具体形式:Microsoft 365 Copilot 无缝集成到不同应用中。根据微软的演示,未来 Copilot 能够无缝植入到 Microsoft 365 当中,并在多个场景发挥作用,具体包括:

Word 中的 Copilot 在人们工作时能够进行编写、编辑、总结和创建。例如“创 建一个关于销售数据的报告”,Copilot 就会根据提示,并基于可使用的数据文件, 生成一个文档的初稿。然后,可以根据需要编辑生成的文本,选择接受或拒绝 AI的修改。用户可以通过点击工具栏中的“Copilot”图标来激活 Copilot 在 Word 中的功能。在微软的演示中,展示了:1)根据文档的数据,起草初稿。2)调整 文档段落语气。3)根据大纲输出文档。

PowerPoint 中的 Copilot 通过自然语言命令将想法转化为设计的演示文稿。 Copilot 会利用 Microsoft Graph 和大型语言模型的信息和能力,生成包含相关 内容、图片和动画的演示文稿。Copilot 还可以帮助优化和调整演示文稿,让它 更符合用户的偏好和风格。目前能够支持创建、新增素材、文字文档与备注的切 换、格式与布局的优化、数据可视化等能力。

Excel 中的 Copilot 有助于在很短的时间内给出结论、识别趋势或创建具有专业 外观的数据可视化效果。在微软的演示中,包括:1)按类型和渠道分解销售数 据,并插入表格。2)预测变量变化,生成可视化图表。3)模拟数据变化对计算 结果的影响。

Outlook 中的 Copilot 可以帮助合成和管理收件箱,以便将更多时间花在实际通 信上。包括回顾过去邮件的内容并标记要点、根据收到的邮件起草回复、撰写新 邮件草稿等能力,降低阅读和撰写邮件的实际时间成本。

Teams 中的 Copilot 通过直接在对话上下文中的实时摘要和操作项使会议更高 效。Copilot 能够组织关键讨论点,并总结关键行动。根据聊天记录创建会议议 程、确定正确的人员进行后续跟进,并安排下一次检查。

Power Platform 中的 Copilot 将在 Power Apps 和 Power Virtual Agent 中引 入两项新功能,帮助所有技能水平的开发人员使用低代码工具加速和简化开发。 GitHub 数据显示,使用 GitHub Copilot 的开发人员中,有 88%的人表示使用该 工具后他们更加高效,77%的人表示该工具帮助他们减少了搜索信息的时间,74% 的人表示他们可以将自己的精力集中在更令人满意的工作上。

商务聊天汇集了来自文档、演示文稿、电子邮件、日历、便笺和联系人的数据, 以帮助汇总聊天、编写电子邮件、查找关键日期,甚至根据其他项目文件编写计 划。让整个团队保持在同一页面,并共同推动工作。花更少的时间关注工具,更 多的时间关注最重要的工作。

除了微软 Copilot 外,Adobe 和 Salesforce 也推出基于 AI 的服务。以 Adobe 为例, Firefly 通过独立网址被访问期间,在 2023 年的 3 月 21 日到 6 月 8 日的 2 个多月时间里 帮助用户生成超过 2 亿张图片,被整合进入 Photoshop 应用后,在 5 月 23 日到 6 月 8 日 的 2 周多时间内帮助用户生成超过 1.5 亿张图片。

软件 SaaS 应用的流量基础优势显现,叠加 AI 应用提升用户体验,可以进一步显著 提升用户粘性。如果微软 Copilot 能够证明“加量可加价”逻辑的成立,意味着软件 SaaS 公司的市场空间 TAM 将被进一步打开。未来一旦进入美元降息周期,叠加 SaaS 行业 TAM 扩大,美股 SaaS 板块或将迎来一波重估机遇。中国软件公司亦有望有对标机会。

长期机会:市场对 AI 长期潜力的认知存在预期差

市场目前对 AI 的短期落地能力存在一定高估,但对 AI 长期潜力的认知仍存在一定的 不足。PC 和移动互联网等科技大潮的经验表明,人们倾向于高估新技术带来的短期变化, 低估技术浪潮的长期潜力。在 PC、互联网、智能手机等技术兴起时,我们在 2000 年、2012 年都遇到了市场泡沫的挑战,市场总会在短期内高估新技术带来的影响力。但在长期新技 术又会证明它们的长期潜力,根据 IDC 数据,PC 的峰值年销量约 3.5 亿台,互联网产业巅 峰市值约千亿美元量级;智能手机的峰值销量约 14 亿部,移动互联网产业市值以万亿美 元计。我们认为人工智能 AI 也即将加入上述技术的行列。

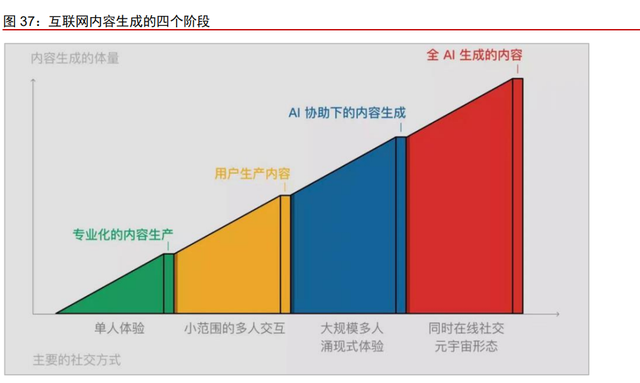

长期来看,人工智能 AI 将带来传统千行百业数字化和智能化,有望打开万亿美元潜 在市场空间和更大规模的市值空间,甚至孕育下一代科技硬件。ChatGPT 的出现所带来的 内容生成能力将会为当今从用户创作(UGC)到 AI 创作(AIGC)的转型提供关键的辅助支 持。目前我们正经历从 Web2.0 开始向 Web3.0 转型的启航阶段,在过去五年我们已经看到 内容创造从专业创作(PFC)转型为了用户创作(UGC)。而在不远的将来,AI 协助内容生 成(AIUGC)与 AI 创作(AIGC)将为我们提供更低的创作门槛以及更丰富的创作思路。在 这两个阶段中,内容生产主体从人类本身开始向人工智能迁移,主要区别体现在内容的生 产效率、知识图谱的多样性以及提供更加动态且可交互的内容上。人脑只能基于自己的知 识图谱进行少数方向的信息处理,而 AI 能从更庞大的知识体系中进行多个方向的处理, 进而提供更多的创作思路。Gartner 预计,到 2025 年,生成式人工智能将占所有生成数据 的 10%。此外我们会看到,空间计算、智能汽车、机器人等行业,亦有望随着 AI 的发展迎 来下一轮的重构。

算力的快速发展是我们在最近五年内看到的确定性最强的趋势。根据英伟达官网公布 的数据,从 2016 至 2022 年,训练相同 ResNet 模型的速度快了 15 倍。2022 年英伟达新推 出的 H100 芯片搭载 Transformer 引擎,使用每层统计分析来确定模型每一层的最佳精度 (FP16 或 FP8),在保持模型精度的同时实现最佳性能,相较于上一代产品提供 9 倍的训 练吞吐量,性能提升 6 倍,但发展迭代速度仍慢于当前需求增长。OpenAI 预计人工智能科 学研究要想取得突破,所需消耗的计算资源每 3-4 个月就要翻一倍,资金也需要通过指数 级增长获得匹配。

此外如苹果 Vision Pro 首次提出“空间计算”等概念,我们也意识到未来 AI+硬件的 结合可望带来更多科技进步可能。苹果 Vision Pro 的空间计算,本质上是基于现实空间 进行计算,并通过 AI 技术加以辅助。用户通过 Vision Pro 看到的所有虚拟画面,都可以 理解为,是在真实世界上叠加了实时计算的可能。交互方式将会从移动互联时代的 2D 转 换为 3D,更符合人类现实生活场景的交互,仅用眼睛、双手、声音进行控制。通过 AI 技 术的帮助叠加已有的 AR 硬件,我们看到了技术间组合进步的更多可能性。

但在这些巨大的长期潜力背后,AI 在短期内需要更多时间来改变行业。AI 的产业链 结构由底层的算力与云平台到中层的模型、数据及基础软件服务再到上层的应用服务构成。 当前,我们看到在算力平台与模型方面都取得了巨大的进步,然而数据端的困境拖慢了 AI 在短期内落地商业化的进度。

我们认为以传统行业为代表的数据治理仍需要进一步提升,来为 AI 补充更好的“弹 药”。在预训练过程中,厂商需要把数据进行系统性的清洗、整理,并将句子进行切割, 备注标签。在进行实例封装的过程中,需要将现有的数据进行详细的标注,并统一格式, 为后续任务输出提供基础,将计算机语言与人类实际需求对齐。而数据清洗、数据标注、 数据结构化、数据规模化等核心环节既需要时间,更需要传统产业决策者的认知提升。

算法方面,幻觉(Hallucination)仍是制约前进的关键因素。大语言模型幻觉指的是 大语言模型在回答的时候仍会产生大量的虚假内容甚至虚构事实进行回答。这一现象的主 要原因之一在于用于训练 LLM 的训练数据,这些数据大部分是基于互联网上的各种新闻、 文章、书籍、网站等覆盖的文本资料。大语言模型的训练过程大多数是基于预测单词的方 式进行预训练,因此它只能保证文本生成的流畅性,而无法辨别所遇到的信息是否真实或 准确。因此如果训练数据中包含一些矛盾或者错误的表述,就可能导致大语言模型也在学 习这些错误的表达,从而一定程度导致了幻觉的产生。

为了减轻幻觉的问题,这要求开发者针对不同的垂直场景的数据进一步微调模型。我 们坚信,AI 在中长期将彻底再造千行百业,带来长期投资机遇,但市场预期提升过快,AI 产业化的大规模落地仍需时间。

投资分析:算力先行,静待 AI 应用大规模落地

在上文中,我们对 AI 的技术演进、短期应用场景、远期机会等进行了系统性的分析, 而落地到投资维度,考虑到各环节不同的成熟度以及商业化时间,其投资节奏亦存在一定 的时间差,在本部分,我们将详细分析 AI 产业链(算力、模型、数据、应用)上不同环 节的落地成熟度,以及对应的投资机会。

1)算力:中短期仍是率先受益、确定性最高的方向。算力层面,目前市场关注 GPU 及其配套,但在广义的算力维度,除高性能计算芯片之外,亦包括云计算、IDC 以及相关 配套,具体而言:

云平台:作为计算层面最为理想的承载者,有望持续受益全球 AI 产业的发展。 目前,全球云计算巨头均发布与 LLM 以及生成式 AI 相关的产品。以海外为例, 云厂商在布局思路、商业化路径等方面存在一定分叉,微软、谷歌依靠闭源模型, 全力打造闭环的 AI 生态,而 AWS 则以相对开放的心态,尝试从不同角度进行 AI 与云计算的融合。我们判断,三大云厂商在云基础设施、模型应用以及商业 细分场景有望持续受益,并有望为产业链带来可观的业绩增量。对应国内市场, 互联网云、运营商云等均具备潜在的投资机会。

产业链:IDC 及液冷等领域有望持续受益。根据 Trendforce 的统计,2022 年 Top4 的云与互联网公司贡献了全球大约 65%的 AI 服务器采购量。AI 的演进将带来数 据中心相关产业的持续推进。在全球市场上,Equinix、DLR 等第三方数据中心 已成为主力供应商。中国市场上,运营商仍占据主导位置,第三方数据中心快速 崛起,数据中心厂商虽短期仍有需求压力,但随着产业出清、AI 带来数据需求, 有望再次受益。而在液冷等环节,随着 AI 服务器和智能联动系统的普及,柜级 全液冷搭配浸没式液冷,以及动环监控系统和 AI 调节的“零碳”数据中心的合 并应用,能够进一步将数据中心的 PUE 降低。

GPU:中短期确定性依旧较高。目前英伟达数据中心加速卡销量仍主要以高端 的 A100/H100 系列卡为主,网络业务主要和其配套销售。需求层面,短期科技 巨头的军备竞赛、创业公司的积极涌入等,叠加主要参与者在模型构建环节的极 大热情等,均有望构成持续的需求支撑;供给层面,目前 A100/H100 仍主要受 制于 HBM(高带宽内存)、先进封装(CoWoS)等,其中台积电 CoWoS 环节 产能为主要约束,考虑到封测设备的交货周期等因素,我们预计台积电 CoWoS 产能实现实质性改善最早要到 2024Q2 左右。同时参考历史经验,短期偏紧的供 给、供需的严重错配等,预计将导致下游客户出现 double booking、over booking 等现象。因此,短期维度(至少 2024Q2 之前),无论是从订单流入、交付量、 价格等维度,英伟达数据中心业务均有望维持强劲,且持续保持季度环比向上, 该种情形亦是周期股理想投资周期。

2)算法:互联网巨头有望受益,同时关注初创公司进展。互联网巨头在 AI 领域投入 已久,百度 2014 年即成立人工智能实验室,阿里巴巴、腾讯、字节跳动也于 2016 年成立 人工智能实验室,此后各家在芯片层、模型层及应用层持续探索,不断完善布局,在研发、 模型、数据、应用等方面已积累显著的先发优势。而对初创公司而言,与头部厂商的合作 与绑定大概率将成为高确定性趋势。

算法模型:追随海外技术进展,研发突破是竞争关键。从技术路线来看,国内大 模型主要追随海外进展。基于谷歌在人工智能领域更高的影响力以及 BERT 开源 代码,前期我国企业在大模型领域的探索更多参考 BERT 路线。随着 ChatGPT 在人机对话领域的超预期表现验证了高质量数据+反馈激励(大模型预训练+小数 据微调)的有效性,国内大模型技术路线也逐渐向 GPT 方向收敛。我们认为, 尽管模型架构设计的不同对特定任务上的表现有一定影响,但国内大模型厂商在 技术上基本同源,从而导致了现阶段较为相似的模型能力,而下一阶段对于 GPT 方向的研发突破将是竞争关键。

算力:互联网厂商在算力资源上具备优势。随着模型参数和复杂度的提升,大模 型对算力的需求也在加速增长。当前国内已发布的大模型中,参数规模达到千亿 及以上的厂商仅为 10 个左右,一定程度上体现出各厂商之间算力能力的差异。 我们认为,互联网厂商在算力资源上具备相对优势,主要原因系:1)互联网企 业业务布局多元,用户基数庞大,海量数据高频更新,使得互联网企业自身对算 力有大量需求,阿里巴巴、字节跳动、百度、腾讯等头部互联网企业是全球芯片 及服务器领域的重要客户。2)阿里云、百度云、腾讯云等为国内头部云厂商, 在云计算中心、AI 算力平台、超算中心等新型高性能计算基础设施上布局领先, 如阿里云推出 PAI 灵骏智算服务,提供覆盖 AI 开发全流程的平台和分布式异构 计算优化能力;腾讯云发布新一代 HCC(High-Performance Computing Cluster) 高性能计算集群,算力性能较前代提升高达 3 倍。

数据:优质开源中文数据集稀缺,自有数据及处理能力构成模型训练壁垒。得益 于开源共创的互联网生态,海外已有大量优质、结构化的开源数据库,文本来源 既包含严谨的学术写作、百科知识,也包含文学作品、新闻媒体、社交网站、流 行内容等,更加丰富的语料数据能够提高模型在不同情景下的对话能力。而受制 于搭建数据集较高的成本以及尚未成熟的开源生态,国内开源数据集在数据规模 和语料质量上相比海外仍有较大差距,数据来源较为单一,且更新频率较低,从 而导致模型的训练效果受限。因此,大模型厂商的自有数据和处理能力构成模型 训练效果差异化的核心。受益于移动互联网时代积累的海量用户、应用和数据,互联网企业在自有数据上更具特色化和独占性,叠加更强大的数据处理能力,从 而能够通过数据优势带来模型训练成果的差异。例如,阿里巴巴在研发 M6 时, 构建了最大的中文多模态预训练数据集 M6-Corpus,包含超过 1.9TB 图像和 292GB 文本,涵盖百科全书、网页、问答、论坛、产品说明等数据来源,并设 计了完善的清洁程序以确保数据质量。百度 ERNIE 模型的训练数据集中也运用 了大量百度百科、百度搜索以及百度知识图谱等生态内数据,通过更高质量的数 据保障了模型的训练效果。

资源投入:互联网厂商重视研发投入,资金及人才实力领先。大模型的训练需要 较高且可持续的研发投入,头部互联网企业兼具高资本密度和高人才密度优势。 资金方面,2022 年,腾讯/阿里巴巴/百度研发费用达 614/567/233 亿元,明显领 先于行业相关公司。人才方面,根据脉脉人才库,在计算机视觉、深度学习、语 音识别、自然语言处理 4 个人工智能重要的技术方向上,互联网大厂是人才储备 最丰富的企业。持续的高研发投入以及极高的人才密度有望驱动头部互联网企业 保持在 AI 及大模型领域的领先优势。

场景:业务丰富多元,互联网厂商天然具备落地实践场景。考虑到数据隐私和安 全合规,初期通用大模型在行业落地时可能会面临一定的信任问题,从而导致较 高的获客成本。而头部互联网平台基于自身在电商、搜索、游戏、金融等领域丰 富的业务积累,天然具备落地实践场景。在提高产品效率的同时,也有望率先形 成示范效应,从而有助于外部客户和应用的拓展。

格局推演:互联网巨头有望保持领先地位,中小厂商或将面临路径选择。综合上 述分析,结合行业竞争要素,并参考海外当前竞争格局,我们认为,国内大模型 赛道有望形成与海外相似的产业趋势,兼具技术、资金、人才和场景优势的头部 互联网企业有望成为大模型领域的重要玩家,而中小厂商或将面临路径选择。一 方面,中小厂商可以利用自身在垂类场景和数据层面积累的优势,成为聚焦垂类 的核心特色玩家;另一方面,基于训练和用户调用带来的算力需求的激增,考虑 到资源优势和经济性,中小厂商或将寻求云厂商的支持和合作。

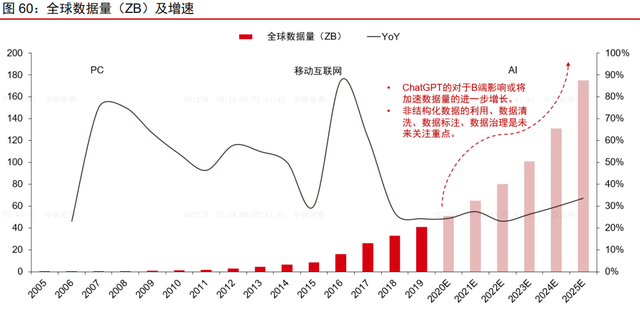

3)数据:AI 的血液与粮食。按照当前 LLM 的技术范式,数据集主要应用于预训练、 模型调优阶段。预训练阶段需要大规模、多类别、高质量的训练数据,在模型调优阶段, 垂类小数据集、提示词工程同样重要。近年来全球数据量呈现爆发式增长,IDC 统计,2019 年全球产生的数据量为 41ZB,过去十年的 CAGR 接近 50%,且预计到 2025 年全球数据 量或高达 175ZB,对应 2019-2025 年仍将维持近 30%的复合增速,其中超过 80%的数据 都将是处理难度较大的文本、图像、音视频等非结构化数据。从 Bert 开始到 GPT-3 再到 谷歌的 PALM,网络中的公开语言数据源已经在被尽可能地利用(论坛、新闻、维基百科 等),但模型优化仍需更多数据,这要求模型开发商有能力接触到优质私有数据来源,从 而才能在模型的数据底层取得差异性的优势。

数据筛选:为 AI 提供高质量数据。ChatGPT 以 GPT 3.5(生成式预训练)模型 进行调优,注重数据质量,以及人类反馈强化学习,让模型在早期开放给大众测 试并收集人类反馈数据,从而显著增强了模型在海量历史数据中挖掘知识的能力, 并最终在人机对话领域获得理想效果。由于不同的行业、不同的业务场景对数据 标注的需求存在一定的差异性,高质量的数据集成为提高数据标注质量的关键。公开数据集可以帮助数据标注团队减少从零开始创建和标注大量数据所需的时 间和成本,且通常由专业团队或机构创建,其数据质量往往较高。这有助于提高 数据标注项目的准确性和可靠性,从而提高整体项目的质量。根据 IDC 发布的 《2021 年中国人工智能基础数据服务市场研究报告》,预计中国 AI 基础数据服 务市场近 5 年复合年增长率将达到 47%,预期 2025 年将突破 120 亿元。

数据管理:AI 产业趋势的核心受益者之一。数据库管理系统是大数据时代的底 层软件和核心支撑。AI 时代数据量爆发、数据结构复杂度攀升,驱动全球数据库 市场长期稳定增长,云化趋势明确。IDC 预计 2020 年全球 DBMS 市场规模受疫 情冲击小幅降至 487 亿美元,但云数据库仍然保持 11.6%增速。IDC 预测 2024 年全球数据库市场规模将稳步增长至 739 亿美元,其中云数据库市场规模将达 404 亿美元,对应 4 年 CAGR 27.3%。Gartner 预测 2024 年云数据库占比将提 升至 75%。IDC 预测,2024 年中国数据库市场规模达 533 亿元,同比增长 32%。 我们预计随着国产化替代的推进,传统海外巨头份额不断缩小。

4)AI+软件的快速融合,正在给全球软件产业带来长周期、深远的影响。针对底层算 法模型,第三方软件服务商需要结合自身专有数据集积累、技术&资金能力、产品形态等, 在闭源方案、开源生态之间做出抉择,彼此优劣势亦十分明显。LLM 带来内容生成、自然 语言交互、信息检索效率的大幅改善,将使得偏平台型、垂类应用软件显著受益,但也将 大概率导致部分业务逻辑简单、偏中间态的单点软件产品方案明显受损,同时借助人机交 互效率的大幅改善,用户对基础软件的使用门槛料显著降低,利好数据管理、信息安全、 运维等基础软件板块。我们判断,LMaaS(大语言模型即服务)、插件(链接外部知识、 工具)、关联落地(Grounding,优化用户提示、输出结果等)等将构成后续软件产业的核 心关键词,不断驱动软件产业平台化、模块化发展,并最终带来更加紧密、复杂的软件产 业分工协作体系。

2B 应用:基于语言模型进行生产力的全面提升。以微软、Salesforce、Adobe 等头部平台为例,模型选择、功能定义和商业化方式将成为全球软件融入 AGI 能力的重要风向标,而后续功能的测试、发布、商业化路径、用户数据等亦均将 成为个股股价和板块表现的重要催化因素。整体来看,AI+软件的快速融合以及 美股软件巨头的示范效应,正在给全球软件产业带来长周期、深远的影响。LLM 带来内容生成、自然语言交互、信息检索效率的大幅改善,将使得偏平台型、垂 类应用软件显著受益,但也将大概率导致部分业务逻辑简单、偏中间态的单点软 件产品方案明显受损,同时借助人机交互效率的大幅改善,用户对基础软件的使 用门槛料将显著降低,利好数据管理、信息安全、运维等基础软件板块。建议不 断聚焦应用层的平台型、垂类软件厂商,以及基础层的数据管理、信息安全、运 维、软件开发等,建议持续关注:微软、Salesforce、Service Now、Adobe、 Snowflake、Datadog、MongoDB、Confluent、Palo Alto、Crowdstrike 等。

伴随 AI 模型的持续发展,算力模型的不断创新,AIGC 对个人的赋能的落地场景逐步 清晰。AIGC 能够在相对较小的边际成本下,大规模提高个人信息的处理效率以及内容输 出的质量。用户付费的逻辑:更高效的信息获取方式;从辅助表达到替代表达;扩大用户 创造力等。

内容生产领域:AIGC 会带动内容消费升级的需求,推动生产成本的下降与效率 的提升。AIGC 的文字、图片、视频内容的生成能力,在生成创意、内容创作等方面对创 作效率的提升非常显著,可以应用于影视、游戏、艺术创作等场景,包括在专业领域带来 工作辅助的作用。

变现模式:在 ToC 端的产品侧主要以用户订阅开始,从与广告、电商增值服务 等相关的协同方、内容和应用场景的协同方进行挖掘。OpenAI 在 ToC 端推出聊天机器人 ChatGPT Plus,每月收取 20 美元。MiniMax 基于三个基础模型的调优测试,推出聊天机 器人 Glow,为用户提供情感陪伴、满足虚构情景想象的体验。三六零将借鉴微软与 OpenAI 能力结合所推出的 New Bing 模式,推出新一代智能搜索引擎,并基于搜索场景推出人工 智能个人助理类产品。

(本文仅供参考,不代表我们的任何投资建议。如需使用相关信息,请参阅报告原文。)

精选报告来源:【未来智库】。「链接」

鲁公网安备37020202000738号

鲁公网安备37020202000738号