“猎杀”时刻结束后,一场「混乱」似乎又在 OpenAI 内部上演。

OpenAI 人才离职潮来了!

仅从时间线来看,这似乎是一次有考虑的行动:

周二凌晨,OpenAI 召开春季发布会,带来了最新的研究成果 GPT-4o;

周三凌晨,Google I/O 大会如期举行,不仅带来了 Sora 的竞品 Veo,也发布了其内部正在尝试的 Agent——Project Astra,对标 GPT-4o;

然而,在关注度上,虽然 Google 带来了不少模型的升级,但似乎还是不如 GPT-4o 更能吸引用户的关注度。似乎是看到了这样稳定的局面,OpenAI 的高层们也开始选择了体面的离开。

正如我们昨日报道的,OpenAI 联合创始人兼首席科学家 Ilya Sutskever 率先提出离职,他说道:

“时隔近十年,我决定离开 OpenAI。这家公司的发展轨迹堪称奇迹,在 Sam Altman、Greg Brockman、Mira Murati 现在再加上 Jakub Pachocki 的卓越研究领导下,OpenAI 将打造出既安全又有益的 AGI。能与大家一起工作是我的荣幸,我会非常想念每一个人。再见,感谢你们所做的一切。我对接下来要做的事情感到兴奋,这是一个对我个人非常有意义的项目,我会在适当的时候分享细节。”

令人没想到的是,几个小时,OpenAI 另一位重要人物 Jan Leike 也在 X 平台上只发了两个简短的单词——“I resigned”(我辞职了),离开了自己在 OpenAI 任职 3 年的生活。

要知道,Jan Leike 是 OpenAI 超级对齐小组的联合负责人,另一负责人就是在他之前刚刚官宣离职的 Ilya Sutskever,这个团队成立的目标是,试图用 20%算力,在未来 4 年解决超级智能对齐问题,致力于使得人工智能系统与人类兴趣保持一致。

同时,Jan Leike 也是 ChatGPT 落地的关键人物。2021 年,OpenAI 团队聘请了 Jan Leike,由他来领导 OpenAI 的对齐团队,主攻人类反馈(RLHF)的 AI 强化学习。从技术上来看,这一点对 ChatGPT 本身进一步提高与人类的交互能力、对信息含义的理解能力以及自我判断能力来说至关重要,因为这项技术加入了更多人工监督进行微调。正因此,ChatGPT 可以拥有更加逼近人类语言的自然反应。

早些时候,Jan Leike 也被《时代》杂志评为人工智能领域 100 位最具影响力人物之一。

与 Jan Leike 官宣离职时的低调相比,就在一个月前,他还非常兴奋地在 X 上讨论关于超级对齐的种种事宜。

两位重量级人物相继离职,不仅给群龙无首的 OpenAI 对齐团队的未来带来一丝阴霾,也让众人嗅到了一丝不寻常的气息,所以其二人评论区,不少网友纷纷好奇留言,“你到底看到什么?”

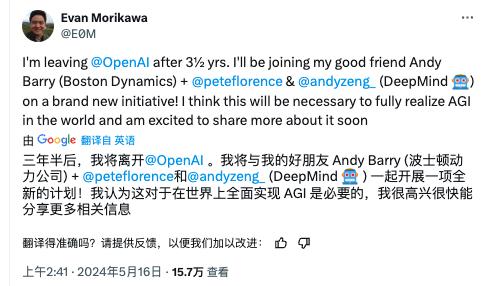

除了超对齐团队两大重量级人物离职之外,就在今天,OpenAI 应用工程团队负责人 Evan Morikawa 也跳了出来表示:

“在 OpenAI 工作三年半年后我选择了离开。我将与我的朋友 Andy Barry、Pete Florence和 Andy Zeng 一起开展一项全新的计划!我认为这对于在世界上充分实现通用人工智能是必要的,并且很高兴能尽快分享更多相关信息。

我在 OpenAI 度过了一生难忘的时光,并对那里的未来感到非常兴奋。当我在 2020 年开始时,应用工程是一个小团队,在原始的 GPT-3 上构建 API(任何人都记得达芬奇)。几年后我对它的结局感到非常自豪。”

内部 AGI 已实现?

对于 OpenAI 离职潮的来临,也有人猜测,或与 AGI 的进展有关。

早些时候,据 Business Insider 报道,曾在 OpenAI 治理团队工作的哲学博士生研究员 Daniel Kokotajlo 上个月离开了公司。他辞职时在一个论坛上表示,“由于对 AGI 时代的 OpenAI 负责任的行为失去了信心,因此退出了 OpenAI。”

在后续帖子上, Daniel Kokotajlo 透露导致他退出 OpenAI 的,与越来越多的人呼吁暂停最终可能导致 AGI 建立的研究有关。

与此同时,同样是在 Jan Leike 和 Ilya Sutskever 团队中担任研究工程师的 William Saunders 也在两个月前离开了公司。

一定程度上来看,Jan Leike 和 Ilya Sutskever 也是 OpenAI 致力于 AGI 不会失控的重要安全守门员。

如今他们的离职,有网友称:

只有在 AGI 已经协调一致或者明显无法实现的情况下,Jan 和 Ilya 才会离开 OpenAI。

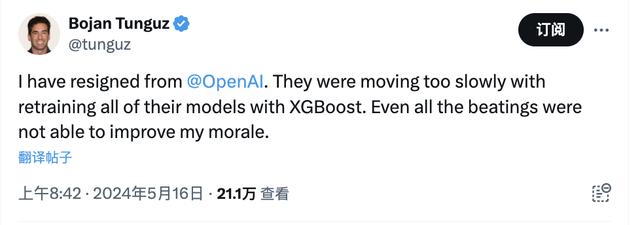

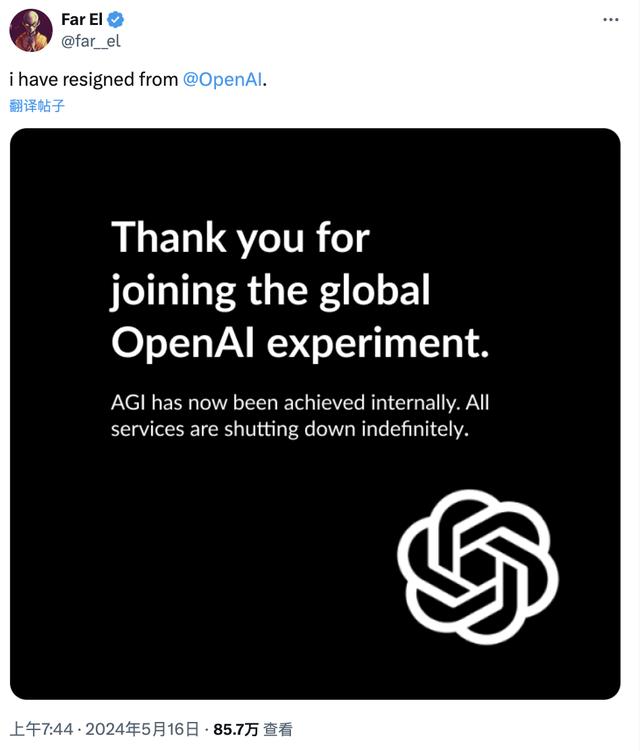

相比后者,更多人宁愿相信是前者,才导致这些人才的离开。也似乎是为了抵制 OpenAI 内部正在做的一些“不为人知”的动作,网友们开始在 X 平台上玩起了“梗”,纷纷用「resigned from @OpenAI」(从 OpenAI 离职)为关键词刷起了屏。

包括 Kaggle 大神、任职于 Nvidia 的 Bojan Tunguz 也在其中,其表示,「我已经从@OpenAI 辞职了。他们用 XGBoost 重新训练所有模型的进度太慢了。即使遭受了所有的打击,我的士气也没能提高。」

更甚的是有用户附上了一张:“感谢您加入全球 OpenAI 实验。AGI 现在已经在内部实现。所有服务都将无限期关闭”的 p 图图片以此来间接抵制“OpenAI 似乎正在对 AGI 失控”的局面。

现在众人使用上的 GPT4o 是个半成品?

这样的猜测不无道理,因为前两天 GPT-4o 的出现,这款既能完成实时对话语音,做到即时响应和情绪感知,又能“看见”事物并进行推理,识别生成图片并给出解释的模型,让不少人大为震惊。

虽然这两天 GPT-4o 也有不少负面缠身,但还是不妨碍很多人认为我们离 AGI 不远了。

至于负面,也只是一个误解。起初,有用户在 OpenAI 开发者社区抱怨道,“我的账户在 iOS 应用程序和浏览器中将 ChatGPT 4o 显示为一个选项,但当我选择它并尝试使用语音功能时,它只是使用标准的 ChatGPT 4 语音模式,而当我用它发信息时,它的行为与 ChatGPT 4 相同。 我相信这些错误会得到解决。不过,本来显示我可以使用这一模型的,但却无法使用,这让人很恼火......”

本以为是个例,但是这条吸引了 19.5k 用户浏览的帖子,数百名用户留言都遇到了这样的情况。

furgoncino_rotore.0m:对我来说也是一样,来自意大利,搭载 iOS 17 的 iPhone 11。应用商店尚未发布任何更新,该型号无法按照规格运行,与上述问题相同。

PapaOssis:在 Pixel 8 Pro 上使用 Android 系统时也会出现同样的情况。在美国。

对于这种情况,Django Web 框架的创建者之一 Simon Willison 发布了一篇完整的帖子说明了大家在用的 GPT-4o,其实只是一个半成品而已。

Simon Willison 表示,发布会结束后,OpenAI 在网络上和应用程序中向 ChatGPT Plus 付费用户提供了新的 4o 模型。但很多人忽略了 OpenAI 官方的一则公告内容:

我们认识到 GPT-4o 的音频模式带来了各种新的风险。今天,我们公开发布文本和图像输入以及文本输出。在接下来的几周和几个月里,我们将致力于技术基础设施、培训后的可用性以及发布其他模式所需的安全性。

这意味着 GPT-4o 的语音功能还尚未对外。

那么,大家的误解究竟是怎么来的?Simon Willison 对此解释道,原来的 ChatGPT iPhone 应用程序已经有图像输出功能,而且已经有语音模式。这些功能在以前的 GPT-4 模式下可以使用,自然在新的 GPT-4o 模式下仍然可以使用......正如下图所示。

Simon Willison 认为,“大多数人不会区分模型和功能”。他在博文中表示:

想想你需要知道什么才能理解这里发生的事情:

GPT-4o 是一种全新的多模式大型语言模型。它可以处理文本、图像和音频输入,并产生文本、图像和音频输出。

但是......到目前为止,通过 API 和 OpenAI 应用程序提供的 GPT-4o 版本只能处理文本和图像输入,并生成文本输出。其他功能还不能在 OpenAI(以及部分合作伙伴)之外使用。

但在应用程序中,它仍然可以处理音频输入和输出,并生成图像。这是因为该模型的应用程序版本被额外的工具所包裹。

音频输入由一个名为 Whisper 的独立模型处理,它能将语音转换为文本。然后将文本输入 LLM,由 LLM 生成文本响应。

该响应会被传递到 OpenAI 名为 tts-1(或许是 tts-1-hd)模型,会将文本转换为语音。

虽然 tts-1 远不如周一演示中的音频效果好,但它仍然是一个令人印象深刻的模型。

至于图像?这些图像是通过 DALL-E 3 生成的,在这个过程中,ChatGPT 会直接提示该模型。

因此,只要你已经了解,ChatGPT 的 GPT-4o 模式是怎么回事就一目了然了:

GPT-4 v.s. GPT-4o

Whisper

tts-1

DALL-E 3

OpenAI CEO 也在今天早晨承认了这一点:“新的语音模式尚未发布(尽管 GPT-4o 的文本模式已经发布)。您当前可以在应用程序中使用的是旧版本。新的非常值得等待!”

对此,有人质疑道,OpenAI 这么做究竟是为什么,为什么不能等几周,直到全部准备好后再宣布呢?

结合 OpenAI 这场发布会的时间,外界普遍猜测此举无疑是针对 Google,彼时 Google I/O 的时间在今年 3 月份便已经定下,而 OpenAI 的春季发布会时间则是在上周才最终官宣出来,且只有 20 多分钟的发布会也不难看出其准备的稍有仓促了。

正因此,有用户评论道:

所以 OpenAI 就是为了狙击 Google 所以提前发布 GPT-4o?

实际上产品还没准备好,匆忙推出了原来架构的模型:GPT+Whisper+ Dalle+TTS 装成一个 Omni 全能模型。

然后还要出来解释。

我觉得要做成一个大公司,没必要做这种事情。真做好了发出来,依然震惊业界。

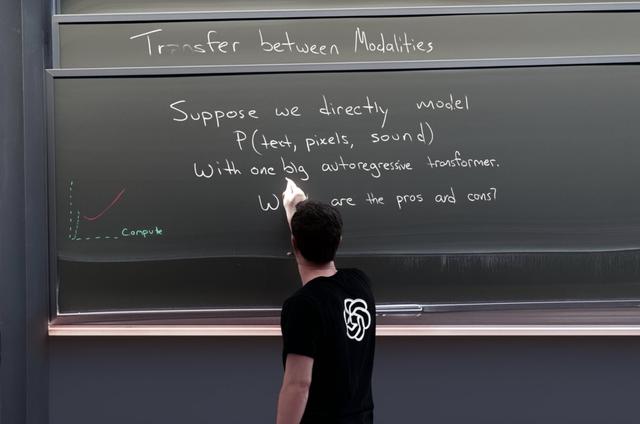

为了稳住众人,OpenAI 总裁兼联合创始人 Greg 又最新分享了一张由 GPT-4o 生成的图片,其中无论是光照、黑板等元素,以及人物及背后企业 logo,宛如真人拍摄。Greg 表示,“仅凭 GPT-4o 的图像生成功能,就有如此多值得探索的地方。团队正在努力将这些成果带给世界。”

然而,面对此时 GPT-4o 功能的不完善,美国 AI 学者加里·马库斯直接“开火”,怒斥道:“给这么蠢的助理加上性感的声音,就像给猪涂口红一样。作为语音助手,LLM 就是一个笑话。任何理智的人都不会相信他们能够处理金钱、规划物流等。”

他还补充说,「恕我直言,他们无意中自欺欺人,无意中暴露了尽管拥有巨大的资源和人才,但他们取得的进展却微乎其微。说实话,4o 的愚蠢让我很惊讶。为什么要发布这个?当 ChatGPT 很蠢的时候,它几乎是可爱的。到现在,18 个月过去了,这真是令人尴尬。」

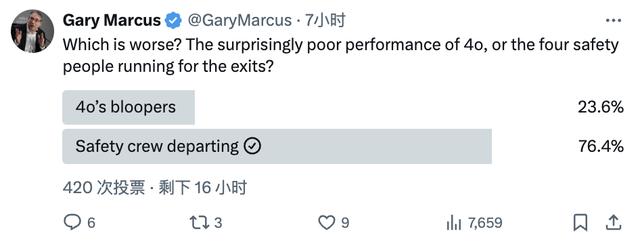

同时,马库斯还发起了一项投票,询问众人“4o 令人惊讶的糟糕表现”和“四位安全人员离职”相比,哪种情况更糟糕?

显然更多的人认为离职潮更让人担心,一直以来,AI 安全深受公众关注,部分原因是人工智能技术的明显激增及其对工作场所的影响,倘若不可控,后果也将不堪设想。对此,你如何看待这一趋势?

参考链接:

https://community.openai.com/t/chatgpt-4o-voice-feature-not-working/744770/2?page=2

https://twitter.com/E0M

https://twitter.com/janleike/status/1790603862132596961

鲁公网安备37020202000738号

鲁公网安备37020202000738号