编辑:LRS

【新智元导读】机器开始理解3D世界了!

通过对齐三维形状、二维图片以及相应的语言描述,多模态预训练方法也带动了3D表征学习的发展。

不过现有的多模态预训练框架收集数据的方法缺乏可扩展性,极大限制了多模态学习的潜力,其中最主要的瓶颈在于语言模态的可扩展性和全面性。

最近,Salesforce AI联手斯坦福大学和得克萨斯大学奥斯汀分校,发布了ULIP(CVP R2023)和ULIP-2项目,这些项目正在引领3D理解的新篇章。

论文链接:https://arxiv.org/pdf/2212.05171.pdf

论文链接:https://arxiv.org/pdf/2305.08275.pdf

代码链接:https://github.com/salesforce/ULIP

研究人员采用了独特的方法,使用3D点云、图像和文本进行模型的预训练,将它们对齐到一个统一的特征空间。这种方法在3D分类任务中取得了最先进的结果,并为跨领域任务(如图像到3D检索)开辟了新的可能性。

并且ULIP-2将这种多模态预训练变得可以不需要任何人工标注,从而可以大规模扩展。

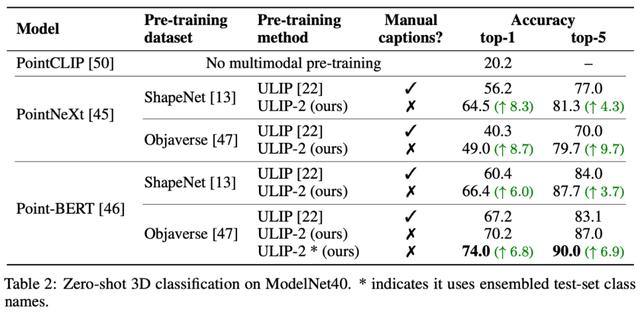

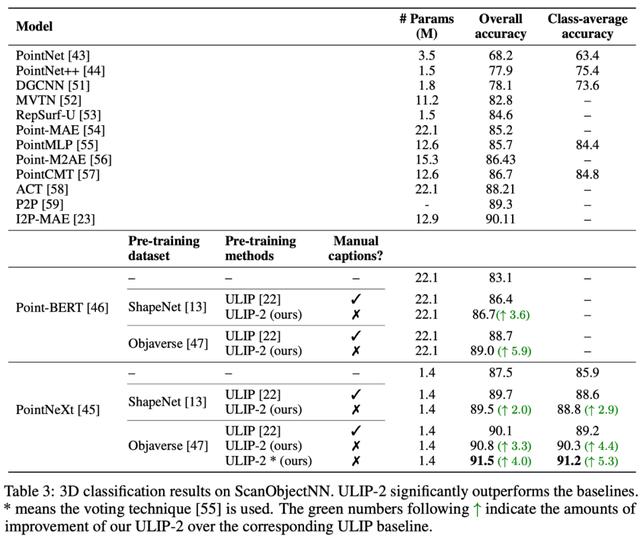

ULIP-2在ModelNet40的下游零样本分类上取得了显著的性能提升,达到74.0%的最高准确率;在现实世界的ScanObjectNN基准上,仅用140万个参数就获得了91.5%的总体准确率,标志着在无需人类3D标注的可扩展多模态3D表示学习方面的突破。

对齐(3D,图像,文本)这三种特征的预训练框架示意图

代码以及发布的大规模tri-modal的数据集(「ULIP - Objaverse Triplets」和「ULIP - ShapeNet Triplets」)已经开源。

背景

3D理解是人工智能领域的重要组成部分,它让机器能像人类一样在三维空间中感知和互动。这种能力在自动驾驶汽车、机器人、虚拟现实和增强现实等领域都有着重要的应用。

然而,由于3D数据的处理和解释复杂性,以及收集和注释3D数据的成本,3D理解一直面临着巨大的挑战。

ULIP

Tri-modal 预训练框架以及其下游任务

ULIP(已经被CVPR2023接收)采用了一种独特的方法,使用3D点云、图像和文本进行模型的预训练,将它们对齐到一个统一的表示空间。

这种方法在3D分类任务中取得了最先进的结果,并为跨领域任务(如图像到3D检索)开辟了新的可能性。

ULIP的成功关键在于使用预先对齐的图像和文本编码器,如CLIP,它在大量的图像-文本对上进行预训练。

这些编码器将三种模态的特征对齐到一个统一的表示空间,使模型能够更有效地理解和分类3D对象。

这种改进的3D表示学习不仅增强了模型对3D数据的理解,而且还使得跨模态应用如zero-shot 3D分类和图像到3D检索成为可能,因为3D编码器获得了多模态上下文。

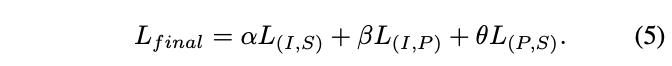

ULIP的预训练损失函数如下:

在ULIP的默认设置中,α被设置为0, β和θ被设置为1,每两个模态之间的对比学习损失函数的定义如下,这里M1和M2指三个模态中的任意两个模态:

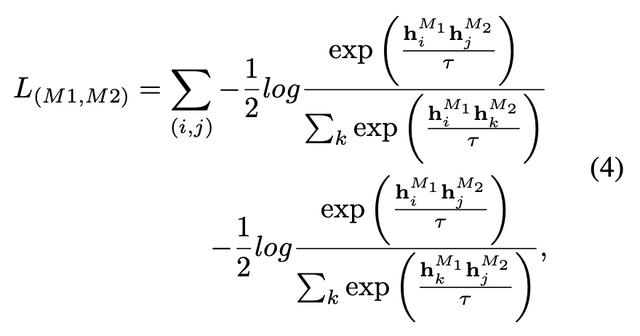

ULIP还做了由图像到3D的retrieval的实验,效果如下:

实验结果可以看出ULIP预训练的模型已经能够学习到图像和三维点云间有意义的多模态特征。

令人惊讶的是,相较于其他的检索到的三维模型,第一名检索到的三维模型与查询图像的外观最为接近。

例如,当我们使用来自不同飞机类型(战斗机和客机)的图片进行检索(第二行和第三行),检索到的最接近的3D点云仍然保留了查询图像的微妙差异。

ULIP-2

这里是一个3D物体生成多角度文字描述的示例。首先,我们从一组视角将3D物体渲染成2D图像,然后使用大型多模态模型为所有渲染出的图像生成描述

ULIP-2在ULIP的基础上,利用大型多模态模型为3D物体生成全方面对应的语言描述,从而收集可扩展的多模态预训练数据,无需任何人工标注,使预训练过程和训练后的模型更加高效并且增强其适应性。

ULIP-2的方法包括为每个3D物体生成多角度不同的语言描述,然后用这些描述来训练模型,使3D物体、2D图像、和语言描述在特征空间对齐一致。

这个框架使得无需手动注释就可以创建大量的三模态数据集,从而充分发挥多模态预训练的潜力。

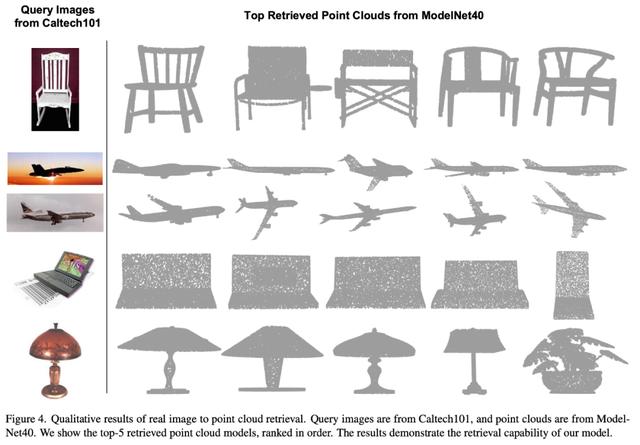

ULIP-2还发布了生成的大规模三模态数据集:「ULIP - Objaverse Triplets」和「ULIP - ShapeNet Triplets」。

两个tri-modal的datasets的一些统计数据

实验结果

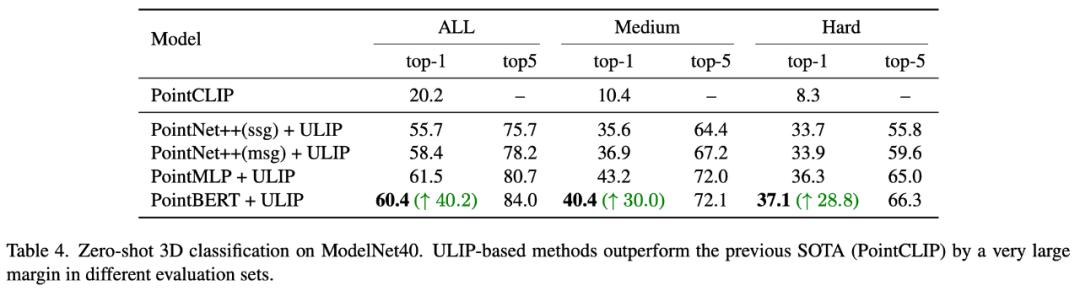

ULIP系列在多模态下游任务和3D表达的微调实验中均取得了惊人的效果,尤其ULIP-2中的预训练是完全不需要借助任何人工的标注就可以实现的。

ULIP-2在ModelNet40的下游零样本分类任务中取得了显著的提升(74.0%的top-1准确率);在真实世界的ScanObjectNN基准测试中,它仅用1.4M参数就取得了91.5%的总体准确率,这标志着在无需人工3D标注的情况下,实现了可扩展的多模态3D表示学习的突破。

消融实验

两篇论文均做了详尽的消融实验。

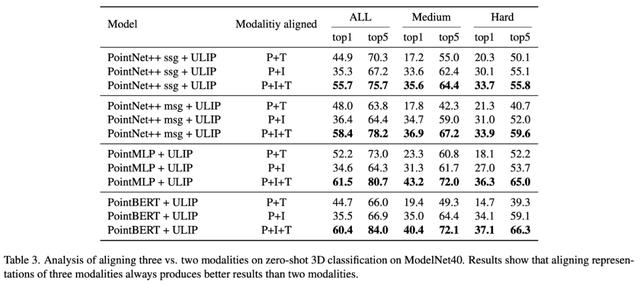

在「ULIP: Learning a Unified Representation of Language, Images, and Point Clouds for 3D Understanding」中,由于ULIP的预训练框架有三个模态的参与,所以作者用实验探究了究竟是只对齐其中的两个模态好还是对齐所有三个模态好,实验结果如下:

从实验结果中可以看到,在不同的3D backbone中,对齐三个模态一致的比只对齐两个模态好,这也应证了ULIP的预训练框架的合理性。

在「ULIP-2: Towards Scalable Multimodal Pre-training for 3D Understanding」中,作者探究了不同的大型多模态模型会对预训练的框架有什么影响,结果如下:

实验结果可以看出,ULIP-2框架预训练的效果可以随着使用的大型多模态模型的升级而提升,具有一定的成长性。

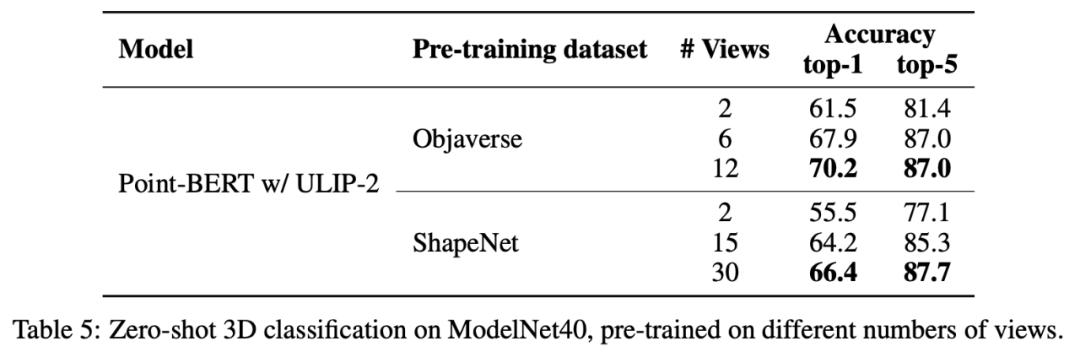

在ULIP-2中,作者还探索了在生成tri-modal的数据集是采用不同数量的视角会如何影响整体预训练的表现,实验结果如下:

实验结果显示,随着使用的视角数量的增加,预训练的模型的zero-shot classification的效果也会随之增加。

这也应证了ULIP-2中的观点,更全方位多样性的语言描述会对多模态预训练有正向的作用。

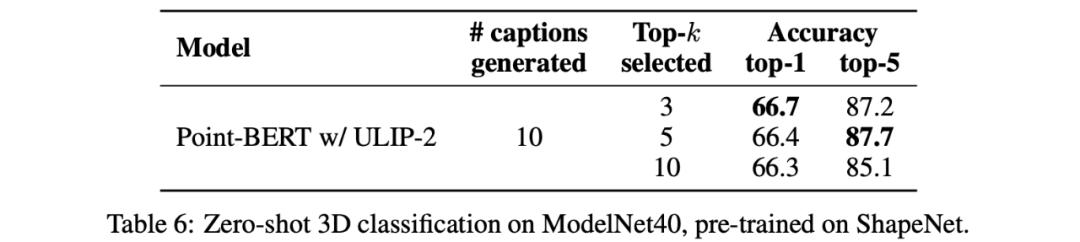

除此之外,ULIP-2还探究了取CLIP排序过的不同topk的语言描述会对多模态预训练有什么影响,实验结果如下:

实验结果表明:ULIP-2的框架对不同的topk有一定的鲁棒性,论文中采用了top 5作为默认设置。

结论

由Salesforce AI,斯坦福大学,得克萨斯大学奥斯汀分校联手发布的ULIP项目(CVPR2023)和ULIP-2正在改变3D理解领域。

ULIP将不同的模态对齐到一个统一的空间,增强了3D特征的学习并启用了跨模态应用。

ULIP-2进一步发展,为3D对象生成整体语言描述,创建并开源了大量的三模态数据集,并且这个过程无需人工标注。

这些项目在3D理解方面设定了新的基准,为机器真正理解我们三维世界的未来铺平了道路。

团队

Salesforce AI:

Le Xue (薛乐), Mingfei Gao (高明菲),Chen Xing(星辰),Ning Yu(于宁), Shu Zhang(张澍),Junnan Li(李俊男), Caiming Xiong(熊蔡明),Ran Xu(徐然),Juan carlos niebles, Silvio savarese。

斯坦福大学:

Prof. Silvio Savarese, Prof. Juan Carlos Niebles, Prof. Jiajun Wu(吴佳俊)。

UT Austin:

Prof. Roberto Martín-Martín。

参考资料:

https://arxiv.org/pdf/2212.05171.pdf

https://arxiv.org/pdf/2305.08275.pdf

鲁公网安备37020202000738号

鲁公网安备37020202000738号